Logistic Regression

Volltext

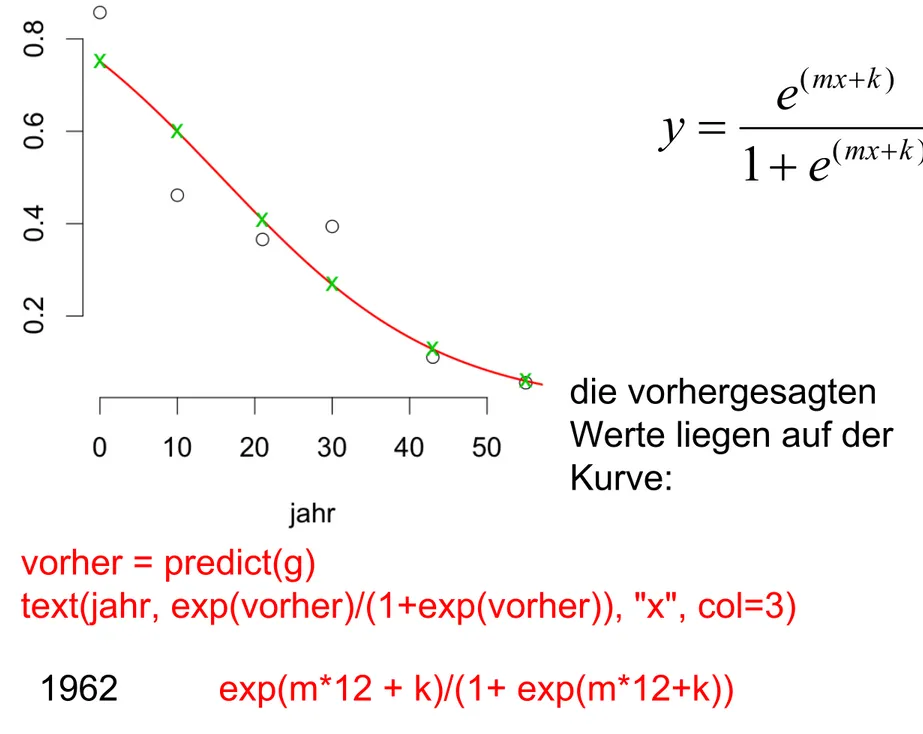

Abbildung

ÄHNLICHE DOKUMENTE

• Bei der Regression soll eine Zielvariable, bezeichnet als abhängige Variable, durch die erklärenden Variablen, bezeichnet als unabhängige Variablen, erklärt werden..

The Logistic Regression will implement both ideas: It is a model of a posterior class distribution for classification and can be interpreted as a probabilistic linear classifier.

as a function of internal noise σ, primary task criterion θ, rating criteria spread τ, shape of the 346.. distributions, and

Es ist zwar so, daß zu den ursprünglich von der Praxis aufgeworfenen Fragen noch eine Reihe weiterer hinzugekommen sind, durch welche eine wissenschaftliche Behandlung der Probleme

■ Assume effect of either independent variable is the same, regardless of the value of the other variable (additivity, parallel regression lines).. ■ Usual assumptions on

Outside this range we get fitted values that are smaller than zero or larger than one.. ◆ Nonparametric regression shows S-shaped fit, not a

One approach that has been used in the literature is to estimate marginal effects by comparing point estimates of the expected probability of various characteristics (Pohlmann

example, the LPC of the impact of female gender on the probability of unemployment can be derived from the results of a logistic regression by estimating the female and male