Bornimer Agrartechnische Berichte

Heft 99

Potsdam-Bornim / Zürich 2018

25. April 2018, Zürich

Leibniz-Institut für Agrartechnik und Bioökonomie e.V. (ATB)

Max-Eyth-Allee 100 I 14469 Potsdam I www.atb-potsdam.de ATB

Bornimer Agrartechnische Berichte

Heft 99 (2018)

24. Workshop Computer-Bildanalyse

in der Landwirtschaft

24. Workshop Computer-Bildanalyse in der Landwirtschaft

25. April 2018, Zürich

Bornimer Agrartechnische Berichte Heft 99

Potsdam-Bornim / Zürich 2018

14469 Potsdam-Bornim

(0331)-5699-0

Fax.: (0331)-5699-849 E-mail: atb@atb-potsdam.de Internet: http://www.atb-potsdam.de

April 2018

Redaktion:

Martin Kraft Michael Pflanz Michael Schirrmann

Typografische Gestaltung:

Andrea Gabbert

Herausgegeben vom Leibniz-Institut für Agrartechnik Potsdam-Bornim e.V. (ATB) mit Förderung durch das Bundesministerium für Ernährung und Landwirtschaft (BMEL) und das Ministerium für Wissenschaft, Forschung und Kultur des Landes Brandenburg (MWFK).

Für den Inhalt der Beiträge zeichnen die Autoren verantwortlich.

Eine Weiterveröffentlichung von Teilen ist unter Quellenangabe und mit Zustimmung des Leibniz-Instituts für Agrartechnik und Bioökonomie e.V. möglich.

ISSN 0947-7314

© Leibniz-Institut für Agrartechnik und Bioökonomie e.V., 2018 2. korrigierte Fassung, April 2018

Inhalt Seite

Grußwort 5

Aussteller:

• spidercam GmbH, Feistritz im Rosental, Austria 6

• geo-konzept GmbH, Adelschlag 8

• Harris Geospatial Solutions GmbH,Gilching 9

• CiS GmbH, Rostock 10

• insensiv GmbH, Bielefeld 11

• ICT-AGRi, Bonn 12

UAV-basierte Multispektral-Sensoren zur Ernteertragsabschätzung im Ackerbau

Adrian F. Meyer, Natalie Lack

13

Analyse von perspektivischen Effekten in Drohnen-basierten RGB- Fotos zur Abschätzung der Blattfläche eines Pflanzenbestandes

Lukas Roth, Helge Aasen, Achim Walter, Frank Liebisch

23

Drohnenbasierte Fernerkundung in der Weizenzüchtung Tina Langkamp-Wedde, Martin Kraft, Heiko Neeland, Katja Matschiner, Lorenz Kottmann, Siegfried Schittenhelm

29

PodCopter ein kabelgebundenes und autonom fliegendes UAV zum Einsatz als zeitlich unbegrenzte Trägerplattform in der Landwirtschaft (Update 2018)

Christian Gieselmann

44

Bildgebende Erfassung hyperspektraler Reflektanzeigenschaften von Pflanzen im Feld: Lessons learned

Jan Behmann, David Bohnenkamp, Anne-Katrin Mahlein

49

Nicht-invasive Charakterisierung von Pilzerkrankungen im Weizen mit Hyperspektralsensoren

David Bohnenkamp, Jan Behmann, Ulrike Steiner, Anne-Katrin Mahlein

56

CropWatch - Informationssystem zur Prozesskontrolle und - analyse in der Pflanzenproduktion

Andreas Honecker, Henrik Schumann, Jens Léon, Diana Becirevic, Lasse Klingbeil, Heiner Kuhlmann, Kai Volland, Andreas Schmitz, Steffi Forberig, Hinrich Paulsen

62

Automatische Rückenlinienanalyse bei Milchkühen aus Bilddaten Torsten Fiolka, Florian Schächter, Josef Heinskill

71

Ciro Potena, Alberto Pretto, Marco Imperoli, Daniele Nardi

Classifying sugar beets and weeds by using systhetically generated 80 data

Spatio Temporal Spectral Mapping of Agricultural Fields using UAVs Raghav Khanna, Thanujan Mohanadasan, Inkyu Sa, Frank Liebisch, Juan Nieto, Roland Siegwart

81

Zur kostengünstigen Erfassung von Wasserdefiziten bei Kulturpflan- zen mit Hilfe von RGB- und NIR-Aufnahmen

Sandra Münzel, Johannes Boisserée, Oswald Blumenstein

82

Exaktere flächendeckende UAV-Karten durch Kombination hoher und tiefer Flüge

Ludwig Schrenk

94

Strategische Forschungs- und Innovationsagenda für die IKT in Land- und Ernährungswirtschaft (Zwischenversion), ICT-AGRI 2

Christopher Brewster, Jan Erpenbach, Raymond Kelly, Fleur Marchand, Peter Rakers, Iver Thysen, Jürgen Vangeyte, Astrid Willener

101

UAV generierte 3D Punktewolken für einen präzisen Pflanzenschutz im Obstbau

Michael Pflanz, Marius Hobart, Christian Scheer, Magdalena Proske, Michael Schirrmann

107

Comparison of visible imaging,thermography and spectrometry meth- ods to evaluate the effect of Heterodera schachtii on sugar beets

Samuel Joalland, Claudio Screpanti, Frank Liebisch, Achim Walter

115

Drohnenfernerkundung für Ernteprognosen und Krankheitserkennung im Gemüsebau

Jakob Hütter, Pascal Greutmann, Adrian Meyer, Natalie Lack

116

In der Reihe

Bornimer Agrartechnische Berichte sind bisher erschienen

117

Grusswort

Die Digitalisierung der Landwirtschaft schreitet unaufhörlich voran – und man wünscht ihr allseits, dass sie sieht, wo sie hinläuft. Die Workshop-Reihe ‘Computer-Bildanalyse in der Landwirtschaft’ trägt seit vielen Jahren dazu bei, die Sicht zu schärfen. Auch die- ses Jahr wird es spannende Einblicke in die Sensorik, in das Prozessieren und Fusio- nieren von Sensordaten geben. Flugroboter, autonome Systeme zur Bearbeitung von Feldern und Algorithmen sowie Machine-Learning-Ansätze zur Detektion von Parame- tern der Züchtung und des Managements von Pflanzen und Tieren werden vorgestellt.

Der Erfahrungsaustausch von Anwendern, kommerziellen Anbietern von Produkten und Dienstleistungen sowie Forschenden ist von grosser Bedeutung.

Workshops wie dieser sind eine ideale Plattform, um sich auszutauschen und abzuglei- chen; um den eigenen Horizont zu erweitern und um die Perspektive des Gegenübers einzunehmen. All das sind wichtige Voraussetzungen, um sich orientieren zu können und dann gut informiert den nächsten Schritt anzugehen. Die Brisanz von landwirt- schaftlichen Thematiken wird in den kommenden Jahren leider ebenso wenig abneh- men wie die Notwendigkeit, immer mehr Menschen in Zeiten des Klimawandels gesund und mit nachhaltig erwirtschafteten Produkten zu ernähren. Daher sind wir alle gefor- dert, in einen Dialog miteinander einzutreten und über Grenzen von Fachdisziplinen und Anwendungsfeldern hinweg miteinander dafür zu sorgen, dass eine vielfältige, ökono- misch, ökologisch und sozial nachhaltige Landwirtschaft entstehen kann.

Der Workshop findet dieses Jahr erstmals nicht in Deutschland, sondern an der Eidge- nössischen Technischen Hochschule ETH Zürich und damit in der Schweiz statt. Es ist uns eine Ehre, den Workshop gemeinsam mit den Kolleginnen und Kollegen vom Leib- niz-Institut für Agrartechnik und Bioökonomie (ATB) ausrichten zu dürfen. Wir möchten an dieser Stelle vor allem Dr. Michael Pflanz vom ATB und Martin Kraft vom Thünen- Institut für Agrartechnologie, den beiden langjährigen Organisatoren der Workshoprei- he, aber auch vielen weiteren Helferinnen und Helfern danken, die das Gelingen des Workshops und das Zustandekommen des Tagungsbandes ermöglicht haben. Allen Teilnehmerinnen und Teilnehmern wünschen wir nun einen inspirierenden Workshop mit spannenden Begegnungen.

Frank Liebisch Norbert Kirchgessner Achim Walter

Institut für Agrarwissenschaften, ETH Zürich; Zürich im April 2018

The spidercam

®FPP is a computerised cable suspended sensor carrier perfect for field phenotyping plants. It can move freely in a three dimensional outdoor ar- ea and monitor plants and crops in their natural environment. The collected data of the plant specimen are pure and of high significance, as the FFP system casts negligible shadows or reflections, gener- ates no downwash or influences plant growth factors in any other way.

OVERVIEW

phone: +43 4252 24608 fax: +43 4252 24608 55 mail: austria@spidercam.tv web: www.spidercam.tv spidercam GmbH

Gewerbestr. 10

9181 Feistritz im Rosental AUSTRIA

The spidercam

®FPP was developed for and in co- operation with the Swiss Federal Institute of Tech- nology in Zurich (ETH Zürich). The used technolo- gy is based on the spidercam® broadcast system, a cable robotics solution that has been promi- nently used around the globe for over 15 years.

After two years in development, the first FPP sys- tem was delivered in 2014. It covers an area of about 1 ha making it the worlds largest field phe- notyping system currently in use.

The payload can be chosen freely, with most setups consisting of a vari- ety of IR cameras, multi-spectral cameras, laser and ultrasonic sen- sors.

All equipment is built to handle the

demanding work of field phenotyp-

ing including harsh weather condi-

tions.

IM VERSUCHSWESEN

inventarisieren. kartieren. optimieren.

Tel. +49 (0) 8424 89 89 0 Fax +49 (0) 8424 89 89 80 geo@geo-konzept.de www.geo-konzept.de

IM VERSUCHSWESEN IM VERSUCHSWESEN

BEFLIEGUNG MIT MULTICOPTER

Mit unserem Multicopter können Befl iegungen schnell und einfach durchgeführt werden.

Umfangreiche Schulung im Umgang mit dem Copter und der Datenprozessierung

Einfache Flugplanung und automatisierter Wegpunktfl ug Stabiler Flug ermöglicht hohe Datenqualität und

eine zuverlässige Datenerfassung

Integration von verschiedenen Sensoren möglich HOCHWERTIGE MULTISPEKTRALSENSORIK

Tetracam Multispektralkameras sind perfekt geeignet für das

Versuchswesen. Die spektralen Kanäle sind frei wählbar und können den jeweiligen Wünschen angepasst werden. Das ermöglicht die parzellenspezifi sche Berechnung verschiedenster Indizes. Zusätzlich bietet Tetracam eine Kombination aus Multispektral- und RGB-Kamera oder Multispektral- und Thermalkamera an.

AUTOMATISIERTE BONITUR

geo-konzept bietet Komplettlösungen im Bereich UAV-gestützter Fernerkundung. Speziell im Versuchswesen ermöglicht geo-konzept mit seiner Software (MiniGIS) die Planung und exakte Anlage eines

Versuchs, die Flugplanung für UAV-Missionen, sowie die automatisierte, parzellenspezifi sche Auswertung der erzeugten Daten. Die Bonituren erfolgen präzise, objektiv, eff ektiv und wiederholbar.

SPRECHEN SIE UNS AN!

HarrisGeospatial.com

FOR PRECISION AGRICULTURE

Tight profit margins are nothing new to growers. Fertilizers and crop protection chemicals can easily eat up half of the seasonal expenses for an agribusiness.

On the other side of the equation, crop losses due to disease and pests can take a big bite out of yield. With a large portion of budgets tied up in fixed costs, remote sensing applications provide a way to loosen the margin squeeze.

Imagery from satellites, fixed-wing aircraft, and Unmanned Aerial Vehicles (UAVs) is being heralded as the next frontier in precision agriculture. In order to realize the potential that imagery offers, advanced analysis tools like ENVI need to be used to extract actionable information. ENVI Crop Science now puts the information available from these scientifically proven approaches into the hands of anyone, regardless of their prior experience with remote sensing.

BENEFITS

Ingest any type of data from any sensor

Monitor crop health down to the individual plant level

Detect plant stress and target specific field locations for remediation Monitor crop growth for harvest and yield predictions

Track changes over time and report results in a single image

UNLOCK THE VALUE IN YOUR IMAGERY

Management zones colorized by mean MSAVI2 values. Zones are displayed on top of high resolution orthoimagery obtained from the USGS.

ENVI Crop Science analyzes spectral and spatial data to provide extensive crop health information. This industry- changing solution offers a window into the growth cycle to enable early stress and disease detection so interventions can be implemented before a crop sustains lasting damage.

(40 min, mit 2 Kameras und Geländemodell)

Diverse Kamerasysteme 2- und 3D-Software

für Flug und Auswertung Individuelle Anpassungen

CiS-rostock.de

Der PodCopter nutzt Bildverarbeitung zum dauerhaften und autonomen Steuern in der Landwirtschaft und fliegt zeitlich unbegrenzt in vorgegebener Position zum Fahrzeug. Dies ermöglicht eine Auswertung von vielseitigen Sensoren in Echtzeit.

• Automatisierter Start, Flug und Landevorgang

• Automatische Positionierung zum Fahrzeug während der Fahrt

• 100% autonom fliegendes System

• Einmalige Positionsvorgabe durch Fahrzeugführer je nach Anwendung

Technische Daten:

• Maße: 105 x 105 x 50 cm

• Gewicht: 5 kg

• Aufbau: Kohlefaser Monocoque

• Zuladungsgewicht Sensorik: 1,5 kg

• Kabellänge: Standard = 15m (größere Längen möglich)

• Arbeitsgeschwindigkeit: bis 20 km/h

Anwendungsbereiche:

• Universell einsetzbar für landwirtschaftliche Fahrzeugtypen

• Vielseitige Anwendungsbereiche durch individuelle Ausstattung der Sensorik mit Auswertung in Echtzeit:

Wildtiererkennung / Wärmebildkamera + RGB Kamera

Schnittkantenerkennung,

Hinderniserkennung / 3D Technik

Grünerkennung, Beikrautanalyse / Spektralmessung

S

ENSOR-T

RÄGERPLATTFORMinsensiv GmbH Auf dem Esch 28 D - 33619 Bielefeld Tel: +49 (0) 521 - 32 99 47-0 Fax: +49 (0) 521 - 32 99 47-99

Overall goal: strengthening European research on digitisation in the agrifood system & developing a common European Scientific Research and Innovation Agenda (SRIA)

ICT-AGRI develops international research calls to pool fragmented human and financial resources over the boundaries of the participating countries, in order to improve both the efficiency and the effectiveness of Europe’s research efforts

for sustainable agriculture

• Are you looking for funding?

• Would you like to work in an international research community?

• Would you like to get in contact with the industry?

• Would you like to contribute to the roadmap of European research on

digitisation of the agri-food system?

Find more information under:

http://www.ict-agri.eu/

UAV-basierte Multispektral-Sensoren zur Ernteertragsabschätzung im Ackerbau

UAV-based Multispectral Sensors for Yield Prediction in Agriculture

Adrian F. Meyer, Natalie Lack

Institut Geomatik, Fachhochschule Nordwestschweiz, Gründenstr. 40, 4132 Muttenz E-Mail: adrian.meyer@fhnw.ch

Zusammenfassung: Es wurde untersucht, inwiefern sich Micro-UAV-basierte Radiometrie eignet, um Vegetationsindizes verschiedener Reifestadien zu berechnen, die eine Abschätzung des Ernteertrags für Weizen und Gerste in Abhängigkeit von Anbautechnik, Dünge- und Ernteverfahren erlauben. Dies kann der Landwirtschaft bei großflächiger Anwendung Planungssicherheit und wirtschaftliche Vorteile bieten, die langfristig die Lebensmittelsicherheit erhöhen. Um die Effektivität der Methode zu überprüfen, wurden für dieses Projekt experimentelle Sortenversuche des land- wirtschaftlichen Zentrums Liebegg im Aargau (Schweiz) über vier Jahre hinweg mit verschiedenen Sensoren beflogen und ausgewertet. Diese Studie fokussiert auf die Modellierung auf Basis der Daten von 2016, sowie die Anwendung der Modelle auf die nächste Saison.

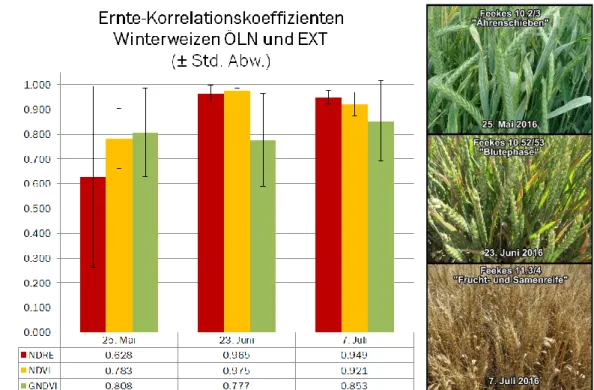

Beim Weizen wurde eine starke sortenabhängige lineare Korrelation zwischen Ernteertrag und dem NDVI (Normalized Differenced Vegetation Index) während der Blütephase mit einem Bestimmtheitsmaß von R² = 0.976 ± 0.012 SD festgestellt. In der sortenunabhängigen Regressionsanalyse erreicht eine Exponentialfunktion das höchste Bestimmtheitsmaß von R² = 0.878. Auch die Vegetationsindizes GNDVI (Green NDVI) und NDRE (Red Edge NDVI) erreichen beim Weizen eine hohe Korrelationsgüte.

Tendenziell eignet sich der GNDVI hierbei eher für frühere Befliegungstermine während des Ährenschiebens, der NDVI für mittlere Termine während der Blütephase und der NDRE für späte Befliegungen in der Reifephase. Die insgesamt höchsten absoluten Korrelationen werden jedoch in der Blütephase erreicht.

Zudem wurden die Wuchshöhen mittels eines geometrischen Crop Surface Models anhand der 3D-Daten berechnet. Diese zeigten allerdings aufgrund des Versuchs- aufbaus meist keine Korrelation mit dem Rohertrag, da einzelne Sorten züchterisch oder durch den Einsatz von Wachstumshemmern trotz niedrigerer Wuchshöhe hohe Ernteerträge erreichten.

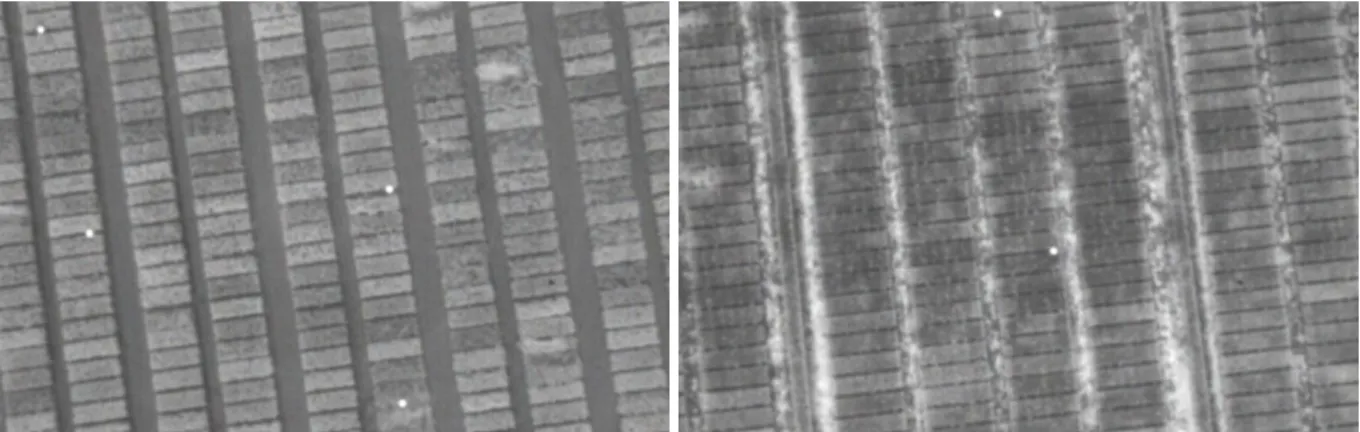

Aufgrund von starken Lagerungserscheinungen bei der Gerste im Jahr 2016 konnte die Erntekorrelation nur unter erschwerten Bedingungen durchgeführt werden. Der NIR- Kanal der Multispektralsensoren eignet sich jedoch sehr gut zur Kartierung der

Standfestigkeit bei der Gerste. Die Bonitierung der Halmlagerung könnte in Zukunft von einer Reflektanzkarte, statt per manueller Erfassung im Feld vorgenommen werden.

Es wurden mehrere mögliche Sensoren verglichen, getestet und auf ihre Anwendbarkeit hin untersucht. Methodisch konnte nachgewiesen werden, dass der berechnete NDVI bei zwei spezifischen Sensortypen von den Werten des hyperspektralen Referenz- spektrometers um nur 0.02-0.04 Indexwerte abweicht (Standard-Abweichung 0.03- 0.05). Damit konnte bestätigt werden (LÄDERACH et al. 2014), dass mit gewissen Sensortypen direkte Aussagen zur Pflanzenvitalität ohne weitere Korrektur oder Referenz-Kalibrierung möglich sind.

Deskriptoren: Micro UAV, Vegetationsindex, NDVI, Red-Edge NDVI, Green NDVI, Fernerkundung, Radiometrie, NIR, Weizen, Gerste, Halmlagerung, Ernteertrag

Abstract: Recent technological developments in multispectral remote sensing sparked widespread interest in the potential applications of Micro-UAVs to predict crop yields.

The project concentrated on estimating the suitability of UAV-based radiometry to calculate vegetation indices during different stages of maturity. These indices allow the estimation of yield predictions for barley and wheat depending on cultivation, fertilization and harvesting techniques. Accurate yield predictions increase the reliability of planning decisions, incorporate economic advantages and therefore contribute in securing long- term nutrition security. To gain insights on the efficacy of this new method, experimental crop plantations of the Agronomy Competence Centre Liebegg (Aargau, Switzerland) were mapped and analyzed while using a variety of different multispectral sensors. This study focuses on models based on 2016 data and their application to the next season.

In flowering stage, wheat was found to display an extraordinarily strong variety-linked linear correlation of NDVI and crop yield (R² = 0.976 ± 0.012 SD). The best fit in the variety-independent regression analysis (R² = 0.839) was found in an exponential correlation between NDVI and crop yield. Other vegetation indices (namely Green NDVI and Red-Edge NDVI) also resulted in high regression coefficients for wheat cultures.

Trends indicate that Green NDVI produced best results in earlier cultivation stages such as the ear emergence phase, standard NDVI could be used for medium stages such as the flowering period, and Red-Edge NDVI performed best in late mapping of the maturity stage. The highest overall correlation was found during flowering stages.

Geometric Crop Surface Models were used in comparison in order to attempt yield predictions based on growth heights. Gross yield and growth height did not correlate, because breeding selection and the usage of growth inhibitors introduced a strong variety-linked bias.

Ears bending was shown to be the limiting factor in the radiometric yield prediction of barley fields in 2016. Mapping should therefore be undertaken at first signs of ears bending, because the reflectance map of the NIR channel proved to be highly sensitive

to its effects. This finding could at least be useful for future productive capacity appraisements, as ears bending assessment is often performed manually to this day.

Multiple sensors were tested for their feasibility. Based on a methodical approach we could show that calculated NDVI values of two specific sensor types deviated from the values of the hyperspectral field spectrometer reference by only 0.02-0.04 (SD 0.03- 0.05). This confirmed previous results (LÄDERACH et al. 2014), that plant vitality predictions based on certain sensors are sufficiently precise to omit the calibration of raw data to spectrometric ground reference.

Keywords: Micro UAV, Vegetation Indices, NDVI, Red-Edge NDVI, Green NDVI, Remote Sensing, Radiometry, NIR, Wheat, Barley, Ears Bending, Yield Prediction

1 Einleitung

Aus dem Bereich der Satellitenfernerkundung sind Vegetationsindizes bereits seit vielen Jahren als probates Mittel bekannt, um agronomische Entscheidungsfindungs-prozesse durch eine Bestimmung der Pflanzenvitalität von Getreideanbauflächen zu unterstützen.

Bedingt durch verhältnismäßig niedrige Bodenauflösungen und Unsicher-heiten bei der Datenqualität und -verfügbarkeit können jedoch häufig nur grobe Aussagen über große Gebiete getroffen werden.

Umgekehrt sind sehr detaillierte und umfangreiche Erkenntnisse aus Labor und Praxis auf Einzelpflanzenebene verfügbar. Dies bedeutet jedoch immer einen hohen Aufwand hinsichtlich der Feldbegehungen und der Analysemethoden.

Der fehlende mittlere Skalenbereich auf Ebene von Bewirtschaftungsparzellen ist jedoch in den letzten Jahren vor allem durch die Verfügbarkeit von leichten, flexiblen, einfach zu bedienenden, unbemannten Fluggeräten mit entsprechender Sensorik und Auswertungssoftware untersuchbar geworden (NEBIKER et al. 2008). Diese Ebene ist für die Entscheidungsfindung hinsichtlich der Sortenwahl, Düngung und Pestizideinsatz für den Agronomen häufig ökonomisch oft mit den wichtigsten Größen verbunden, insbesondere was den Bearbeitungsaufwand und den zu erwartenden Ernteertrag betrifft.

2 Methodik und Datengrundlage

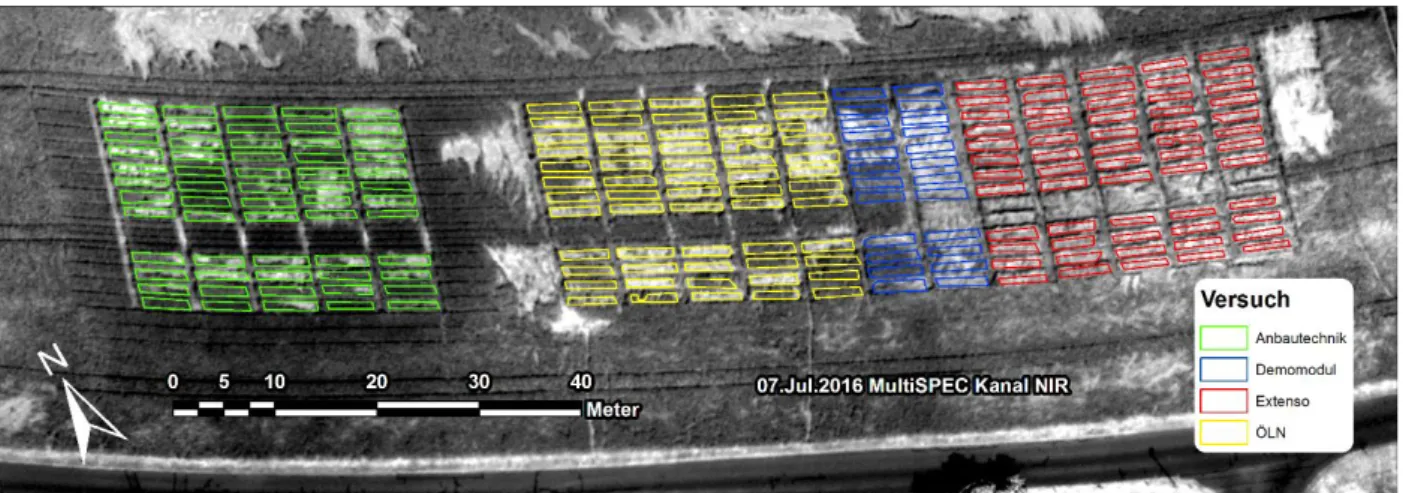

2.1 Versuchsaufbau

In einer bereits vierjährigen Langzeitstudie arbeitet das Institut Geomatik der FHNW deshalb mit dem Landwirtschaftlichen Zentrum Liebegg in Gränichen (Aargau) zusammen, um die Anwendbarkeit der neuen Technologie zur Ernteertragsprognose unter lokalen Bedingungen abzuschätzen (NEBIKER et al. 2016). In diesem Teil des Projektes wurden 2016 Feldversuche überflogen, bei welchen verschiedene Sorten von Winterweizen und Wintergerste in pseudorandomisierten Repetitionen auf jeweils ca.

8 m² großen Parzellen angebaut wurden. Dabei variieren verschiedene Sorten und

Bewirtschaftungsfaktoren wie Anbautechnik, extensive oder intensive Düngung, sowie Pestizideinsatz. Die Versuchsparzellen werden nach der Reifungsphase durch das Landwirtschaftliche Zentrum in Zusammenarbeit mit Agroscope und dem Forum Ackerbau einzeln geerntet, im Labor analysiert, die Widerstandsfähigkeit einer Sorte bewertet, sowie der jeweilige Ernteertrag ermittelt. Die Sortenversuche stellen damit die Grundlage der jährlichen Aussaatempfehlungen dar.

Die Befliegungen wurden als Linienflüge mit dem Fixed-Wing-UAV „Sensefly eBee“

durchgeführt. Die Flughöhe wurde bei ca. 100 m über dem Boden gewählt. Die Bildüberlappung lag horizontal und vertikal bei jeweils 80%. Die Befliegungen der Weizenkulturen in Rohr (bei Aarau) und der Gerstenkulturen in Gränichen fanden am 25.5.2016, am 23.6.2016, sowie am 07.07.2016 statt. Die Befliegungen der abgemähten Wiese zur Generierung des Geländemodells fanden am 30.09.2016 statt.

Um abschätzen zu können, welche Faktoren die Vorhersagbarkeit des Ernteertrags mit multispektraler Radiometrie am stärksten beeinflussen, wurde im Rahmen dieser Studie ein Vergleich verschiedener möglicher Sensoren, Befliegungszeitpunkte, Vegetations- indizes und Korrelationsmodelle angestellt. Die gewonnenen Daten wurden anschlie- ßend mit den im Labor bestimmten Biomassen (Rohertrag), sowie mit terrestrischen, hyperspektralen Referenzmessungen der einzelnen Parzellen in Verbindung gebracht.

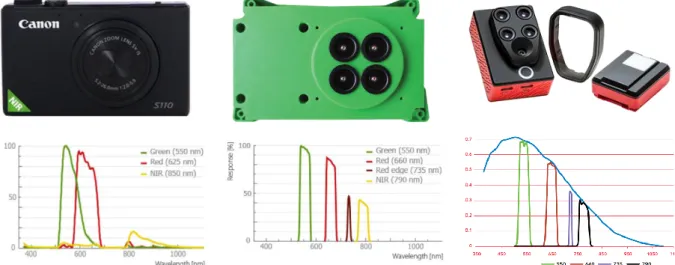

2.2 Sensorvergleich

Verglichen wurden der R/G/NIR-Sensor „Canon S110 NIR“ (Bodenauflösung GSD = 3.5 cm, unkalibriert), der empfindlichere vierköpfige Multispektralsensor „Airinov Multispec 4C“ (GSD = 10 cm, sonneneinstrahlungskalibriert, R/G/Red-Edge/NIR), sowie im letzten Jahr der neue Kombi-Sensor „Parrot Sequoia“ (GSD = 10 cm R/G/Red- Edge/NIR + hochauflösendes RGB, sonneneinstrahlungskalibriert). Alle Sensoren eignen sich für Befliegungen mit der Flächenflüglerplattform „Sensefly eBee“ unter Ausnützung der maximal empfohlenen GSD.

Abbildung 1: Verwendete Sensoren: S110NIR (links), MultiSpec4C (mitte), Sequoia (rechts);

(AIRINOV 2017, MICASENSE 2018, SENSEFLY 2017).

Die bodengestützten, hyperspektralen Referenzmessungen wurden mit dem tragbaren Feldspektrometer „Tec5 Handyspec Field“ durchgeführt. Der Spektralbereich dieser punktbasierten Messungen reicht hierbei von 360 nm bis 1000 nm bei einer Auflösung von Δλ = 10 nm. Damit sind die Spektralbereiche der eingesetzten UAV-Sensoren (Grün = 550 nm bis NIR = 790 nm) abgedeckt. In der Annahme, dass, bei aus- reichender Wiederholung der hyperspektralen Punktmessungen, diese eine exaktere und wissenschaftlich gesichertere Berechnung der Vegetationsindizes (MÜLLER et al.

2008) gegenüber dem UAV-basierten Multispektralsensor zulassen, kann so die Präzision des Multispektralsensors durch statistische Korrelation der Vegetationsindizes ermittelt werden.

Tabelle 1: Mittlere Abweichungen (±Standardabweichung) im berechneten NDVI zwischen terrestrischem Referenz-Feldspektrometer und den getesteten UAV-Sensoren aus den

verschiedenen Versuchsreihen (GREUTMANN &HÜTTER 2017, NEBIKER et al. 2016).

∆NDVI (±SD) 2014 2015 2016 2017

S110NIR -0.26 (±0.05) / in Auswertung in Auswertung MultiSpec4C -0.04 (±0.06) -0.01 (±0.05) -0.02 (±0.03) -0.14 (±0.05)

Sequoia / / / -0.26 (±0.02)

Der für den offenen Markt auf Basis einer Kompaktkamera konzipierte „low cost“- Sensor S110NIR bot im Vergleich die höchste Bodenauflösung (4 cm bei 100 m Flug- höhe) zum niedrigsten Preis. Je nach Anwendungsfall können dies die ausschlag- gebendsten Kriterien darstellen. Die fehlende Korrektur der Sonneneinstrahlung, sowie überlappende spektrale Empfindlichkeitsbereiche machen jedoch den Vergleich von Zeitreihen aufgrund unterschiedlicher Beleuchtungsbedingungen schwierig. Bei einheit- licher Beleuchtung lassen sich jedoch sehr hochaufgelöste Vegetationsindex-Karten, sowie ein genaues digitales Höhenmodell erzeugen. Besonders in Hinblick auf Crop Surface Models und räumliche relative Pflanzenvitalitäts-Unterschiede eines einzelnen Zeitschnitts lassen sich so hochwertige Daten generieren.

Der als Schachtmodul für die eBee konzipierte Multispektralsensor MultiSpec4C bietet bei einem deutlich höheren Preis (ein Vielfaches des S110NIR) eine niedrigere maximale Bodenauflösung (11 cm bei 100 m Flughöhe). Die vier physikalisch ge- trennten Sensorköpfe zeigten jedoch im Vergleich mit dem Referenzspektrometer die geringsten getesteten Abweichungen und somit die höchste radiometrische Präzision (siehe Tabelle 1). Vor allem die automatisierte Sonneneinstrahlungskorrektur erwies sich als hilfreich beim Zeitreihenvergleich mehrerer Wachstumsstadien der gleichen Getreidekulturen. Als nachteilig erwies sich die schwierige Georeferenzierung aufgrund der relativ der grob aufgelösten Orthophotos. Um eine hinreichende Überlagerungs- treue der Zeitschnitte zu erreichen und die Interpretation zu erleichtern, wurden zusätzliche Orientierungsflüge mit einer RGB-Kamera ausgeführt.

Erste Auswertungen (GREUTMANN & HÜTTER 2017) weisen darauf hin, dass der neue Parrot Sequoia Sensor vergleichbare Ergebnisse liefert wie der MultiSpec4C.

Hinsichtlich der radiometrischen Eigenschaften der Multispektralkanäle zeigte sich im Vergleichstest mit dem Referenzspektrometer bei den berechneten NDVI-Werten ein starker Versatz (-0.26), wobei die Verteilung innerhalb der Stichprobe jedoch ausgesprochen niedrig war (Standardabweichung 0.02) (siehe Tabelle 1). Mittels eines rechnerischen Offsets könnten also trotzdem radiometrisch plausible Daten aus dem Sensor gewonnen werden. Der zusätzlich integrierte RGB-Sensor soll den erwähnten Nachteil der notwendigen Mehrfachbefliegungen beim Multispec4C beheben. Durch den „Rolling Shutter“-Mechanismus kommt es jedoch im Flug zu starken Bildverzerrungen, sodass sich diese RGB-Bilder nicht für die Generierung einer 3D- Punktwolke eignen.

Auf Basis der oben genannten Erkenntnisse fiel die Wahl des Sensors für die Durchführung der Ernteertragsschätzung schließlich auf den MultiSpec4C. Wenngleich der Befliegungsaufwand durch zusätzliche RGB-Flüge höher ausfiel, so verspricht der Sensor doch bei einer ausreichenden räumlichen Auflösung für diese Anwendung die radiometrisch genauesten Aussagen zum Pflanzenstress. Damit stellt er eine solide Datengrundlage für die Entwicklung von Prognosemodellen dar.

2.3 Prozessierung

Abbildung 2: Flugbahn (links); Generierte Punktwolke (mitte); Orthophoto mit NDVI (rechts)

Die Befliegungen werden mittels der von Sensefly zur Verfügung gestellten Software

«eMotion» geplant und anschließend von der Drohne semi-automatisiert ausgeführt.

Erfolgreiche Befliegungen werden mit der Software «PostFlight Terra 3D»

(sensefly/Pix4D) prozessiert. Dabei werden manuell eingemessene Passpunkte (Ground Control Points – GCPs) zur Präzisierung der Georeferenzierung angegeben.

Die Kameraparameter und die vor der Befliegung durchgeführte radiometrische Kalibrierung der Bilder werden automatisch in die Auswertung übernommen. Über den Zwischenschritt der Bündelblockausgleichung und der Punktwolkengenerierung werden als Produkte das DSM (Digitales Oberflächenmodell), Orthophotomosaike und orthorektifizierte Vegetationsindexkarten mit jeweils höchstmöglicher Bodenauflösung generiert. Als universelle Rasterdaten können diese in GIS-Applikationen weiterver- wendet werden.

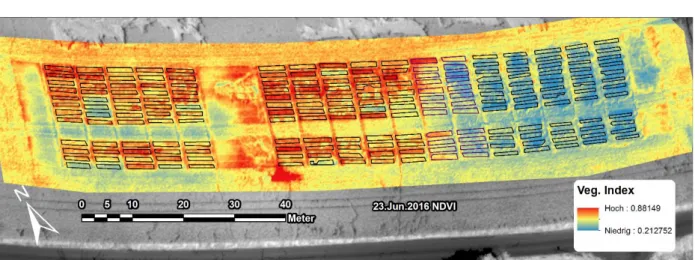

Durch eine Überschneidung der Indexkarten mit den Polygonen der Versuchsflächen kann im GIS eine zonale Statistik über die enthaltenen Pixel durchgeführt werden. Der generierte Vegetationsindex-Mittelwert kann anschließend mit den Laborwerten des LWZ Liebegg und Agroscope auf Einzelparzellenebene korreliert werden.

3 Resultate und Analyse 3.1 Ertragsschätzung Weizen

Abbildung 3: Weizenversuchsparzellen am Standort Rohr (Aargau) während der Blütephase (23.6.2016); links in der RGB-Übersicht, rechts als Falschfarben-NDVI (blau 0.5; rot 1.0); die

Fahrstraße trennt das extensive vom intensiven (ÖLN) Bewirtschaftungsschema.

Abbildung 4: Durchschnittliche Korrelation (R²) mit Standardabweichung aus einer linearen Regression des Ernteertrags pro Sorte in dt/ha mit dem Vegetationsindex aus den

Befliegungsbildern.

Die meisten Sorten eignen sich sowohl bei intensiver, als auch bei extensiver Bewirtschaftung für eine Analyse im Juni oder Juli mit den Indizes NDVI oder NDRE (Red-Edge NDVI). Der NDVI des 23. Juni 2016 erreichte den höchsten durch- schnittlichen Korrelationskoeffizienten. Während die Korrelationskoeffizienten hier für jede Sorte einzeln R² ≥ 0.95 betragen, unterscheiden sich jedoch die Steigungen und Offsets in der linearen Regression geringfügig. Für eine hochgradig präzise Ernteertragsabschätzung sollte also zunächst die sortenspezifische Abhängigkeits- funktion von Ernteertrag und NDVI bekannt sein.

Die sortenunspezifische Korrelation liegt bei R² = 0.839, beziehungsweise unter Verwendung eines exponentiellen Regressionsmodells bei R² = 0.878. Der GNDVI (Green NDVI) und NDVI liefern im Mai eine frühzeitige aber etwas weniger präzise Erntekorrelation. Die Ergebnisse sind dabei sortenabhängig stärker gestreut, als bei späteren Zeitschnitten: 58% der getesteten Sorten wiesen im Mai-GNDVI eine Korrelation von R² > 0.9 auf, während weitere 25% weniger als R² < 0.6 erreichten. Die Korrelation dieser spezifischen Sorten fiel hingegen mit dem Standard-NDVI wiederum besser aus.

Für die Berechnung des Crop Surface Models wurden zwei digitale Geländemodelle aus RGB-Flügen mit 4 cm GSD erzeugt. Dabei wurde die Geländehöhedifferenz zwischen der abgemähten Wiese im September und der Weizenwuchshöhe im Mai mittels Rastersubtraktion berechnet. Trotz relativ präzise ausgerichteter und hochauf- gelöster Höhendaten zur Differenzberechnung konnte keine Korrelation – weder zwischen Sorten noch innerhalb einer Sorte – von mittlerer Wuchshöhe und Biomasse (Rohertrag pro Fläche) gefunden werden. Möglicherweise können züchterische Eigenheiten der einzelnen Sorten oder der Einsatz von Wachstumshemmern im ÖLN- Verfahren zur Verkürzung der Ähre bei gleichzeitiger Steigerung der Bioproduktivität als Auslöser dieses Effekts in Betracht gezogen werden.

3.2 Ertragsschätzung und Halmlagerung bei der Gerste

Abbildung 5: NDVI Falschfarben-Orthophotomosaik zeigt einen deutlichen Unterschied in der Pflanzenvitalität zwischen extensiven (rechts, blau) und intensiven ÖLN-Anbaubedingungen

(mitte, rot).

Trotz der starken Halmlagerung bei der Gerste (ein Grund für das schlechte Erntejahr 2016 mit Einbußen von 13% im bundesdeutschen Durchschnitt) und der hohen Emp- findlichkeit in der NIR-Reflektanz gegenüber den geknickten Ähren ließ sich am 23.06.2016 noch eine leichte Korrelation zwischen NDVI und Ernteertrag feststellen (R² = 0.69). Alle anderen untersuchten Zeitpunkte und Indizes ließen keine signifikante Korrelation erkennen. Ob Juni-NDVI und Ernteertrag nun aufgrund der Halmlagerung oder trotz dieser korrelieren, lässt sich mit den vorliegenden Daten nicht abschließend beantworten.

Abbildung 6: Aus dieser Karte wird einerseits der Versuchsaufbau des Gerstenfelds, sowie die enorme Empfindlichkeit des NIR-Kanals gegenüber Halmlagerungseffekten deutlich.

Die Standfestigkeit der Ähren wird als agronomischer Parameter durch das LWZ Liebegg mittels einer Bonitierungsskala von 1 (alle Halme stehen aufrecht) bis 9 (voll- ständig gelagert) manuell im Feld eingeschätzt. Unter der Annahme einer quantitativen Linearität dieser Skala wurden die Bonitierungsnoten mit den radiometrisch beachteten Lagerungsanteilen korreliert. Dabei zeigte sich, dass die mittlere Reflektanz im NIR- Kanal mit einer Bestimmtheit von R2 = 0.64 der jeweiligen Bonitierungsnote des Ver- suchsplots zugeordnet werden konnte. Auch die Verwendung des mittleren NDRE er- reicht noch eine vergleichsweise hohe Korrelationsgüte (R2 = 0.60). Die aufwändige Bonitierung könnte daher in Zukunft durch eine kurz vor der Ernte erzeugte Reflektanz- karte ersetzt werden.

4 Diskussion

Auf Grundlage der vorliegenden Daten kann die Tendenz festgestellt werden, dass – mit zunehmendem Reifezustand des Weizens – eine größere Wellenlänge λ für den jeweils zur Berechnung herangezogenen kurzwelligen Kanal (Grün, Rot oder Red Edge) besser korrelierende Ergebnisse bei der Indexberechnung erbringt. Dies korrespondiert zeitlich mit dem zur Reifung notwendigen Abbau des Chlorophylls in den Weizenzellen und der damit verbundenen Spektralverschiebung der Reflektanz hin zu grösseren (also «roteren») Wellenlängen. Eine höhere Korrelation des GNDVI

gegenüber dem NDVI in der Phase des Ährenschiebens findet sich auch bereits bei WANG et al. (2014). Auch die höhere Korrelation des NDVI gegenüber dem GNDVI in der Blütephase kann bestätigt werden (WANG et al. 2014). Während der späten Reifephase konnten jedoch wesentlich höhere Korrelationen als angegeben erreicht werden (vgl.: NEBIKER et al. 2016).

Die angestellten Beobachtungen zur Gerste liefern aufgrund der Halmlagerung weniger eindeutige Resultate. Speziell der NDVI zeigte im Juni jedoch eine gewisse Robustheit gegenüber den Lagerungserscheinungen, sodass eine Ernteprognose nach wie vor möglich erscheint. Gleichzeitig wird jedoch deutlich, dass weitere Daten aus Jahren ohne Halmlagerung notwendig sind, um zweifelsfreie Aussagen treffen zu können.

An diese Studie anschließende Beobachtungen durch GREUTMANN &HÜTTER (2017) auf den Versuchsfeldern des LWZ Liebegg geben Hinweise, dass die vorgeschlagenen Modelle für Ernteprognosen des Folgejahres unter Berücksichtigung zusätzlicher sortenspezifischer und witterungsabhängiger Eigenschaften erfolgreich anwendbar sind. Eine präzise Quantifizierung dieser Parameter bedingt dabei die Analyse mehrjähriger Befliegungsergebnisse und befindet sich derzeit noch in der Auswertung.

Literaturverzeichnis

AIRINOV (2017): AIRINOV multiSPEC 4C pour eBee [WWW Document]. AIRINOV. URL https://odoo.airinov.fr/shop/product/airinov-multispec-4c-pour-ebee-2 (accessed 1.2.17).

GREUTMANN P,HÜTTER J(2017): Drohnenfernerkundung für Ernteprognosen und Krankheitser- kennung im Gemüsebau (Bachelor Thesis). Fachhochschule Nordwestschweiz, 4132 Mut- tenz, Switzerland.

LÄDERACH S, LACK N, NEBIKER S(2014): Micro-UAV und neue leichtgewichtige Multispektral- sensoren für agronomische Anwendungen. Bornimer Agrartechnische Berichte 88.

MICASENSE (2018): Parrot Sequoia [WWW Document]. MicaSense. URL https://www.micasense.com/parrotsequoia/ (accessed 3.14.18).

MÜLLER K, BÖTTCHER U, MEYER-SCHATZ F,KAGE H(2008): Analysis of vegetation indices de- rived from hyperspectral reflection measurements for estimating crop canopy parameters of oilseed rape (Brassica napus L.). Biosystems Engineering 101, 172–182.

NEBIKER S, ANNEN A, SCHERRER M, OESCH D (2008): A light-weight multispectral sensor for micro UAV—Opportunities for very high resolution airborne remote sensing. The interna- tional archives of the photogrammetry. Remote Sensing and Spatial Information Sciences 37, 1193–1199.

NEBIKER S,LACK N,ABÄCHERLI M,LÄDERACH S(2016): Light-weight multispectral UAV sensors and their capabilities for predicting grain yield and detecting plant diseases. The Internation- al Archives of Photogrammetry, Remote Sensing and Spatial Information Sciences 41, 963.

SENSEFLY (2017): Accessories: senseFly SA [WWW Document]. URL https://www.sensefly.com/drones/accessories.html (accessed 1.2.17).

WANG L, TIAN Y, YAO X, ZHU Y,CAO W(2014): Predicting grain yield and protein content in wheat by fusing multi-sensor and multi-temporal remote-sensing images. Field Crops Rese- arch 164, 178–188. https://doi.org/10.1016/j.fcr.2014.05.001

Analyse von perspektivischen Effekten in Drohnen-basierten RGB-Fotos zur Abschätzung der Blattfläche eines

Pflanzenbestandes

Extracting Leaf Area Index Using Viewing Geometry Effects in Unmanned Aerial System Photography

Lukas Roth, Helge Aasen, Achim Walter, Frank Liebisch

Institut für Agrarwissenschaften, ETH Zürich, Universitätstr. 2, 8092 Zürich, Schweiz.

E-Mail: lukas.roth@usys.ethz.ch

Zusammenfassung: In der Agronomie wie auch in der Pflanzenökologie und Pflanzen- physiologie spielt die Bestimmung des Blattflächenindex (LAI) eine wichtige Rolle, denn der Blattflächenindex gilt als wichtiger Indikator für Wachstum und Ertrag. Die Erfas- sung des LAI durch Messungen am Boden ist sehr zeitintensiv, weswegen Methoden zur Bestimmung desselben mittels Drohnen ein hohes Optimierungspotential bieten.

In einer aktuellen Studie haben wir RGB-Fotos, die mittels einer Drohne erfasst wurden, auf die Eignung zur Extraktion von LAI untersucht. Die Drohne erfasste dabei beim Überflug Pflanzenbestände aufgrund der Eigenschaften eines bildgebenden Sensors aus verschiedenen Blickwinkeln. Perspektivische Effekte führen zu einer Veränderung der sichtbaren Blattfläche pro Bild. In einer Simulation konnten wir zeigen, dass diese Veränderungen in Relation zur Größe der Gesamtheit der beobachteten Blattfläche steht. Mittels eines mathematischen Modells haben wir in der Folge den Blattflächenin- dex aufgrund der Veränderung der sichtbaren Blattfläche in verschiedenen Bildern be- rechnet.

Die Eignung des Modells wurde in einem Soja-Feldversuche überprüft. Destruktive Blattflächenmessungen sowie Messungen mit einem LAI Meter (LI-COR 2200) dienten dabei als Validierungsgrundlage. Die ermittelten Blattflächen zeigten eine gute Korrela- tion mit LI-COR 2200 Messwerten (R2 = 0.92, RMSE = 0.42 m2m−2) wie auch mit de- struktiven Messwerten (R2 = 0.89, RMSE = 0.41 m2m−2). Wir schließen daraus, dass Blattflächenanalysen aufgrund von perspektivischen Effekten in RGB-Fotos eine valide Alternative zu Messungen am Boden darstellen.

Anmerkung: Bei diesem Bericht handelt es sich um eine gekürzte, deutsche Überset- zung eines Forschungsartikels der aufgeführten Autoren, welcher in einem internationa- len Journal eingereicht wurde und momentan im Review-Prozess ist. Interessierte ver- weisen wir gerne auf den Artikel “Extracting Leaf Area Index Using Viewing Geometry Effects—A New Perspective on High-Resolution Unmanned Aerial System Photo- graphy” sobald dieser verfügbar ist.

Deskriptoren: LAI, gap fraction, high-troughput phenotyping, Soja, active learning, Segmentierung

English version:

This text represents a translated abstract of a research article that was submitted to an international scientific journal and is currently under review. We kindly refer the English speaking reader to the prospective original text entitled “Extracting Leaf Area Index Us- ing Viewing Geometry Effects—A New Perspective on High-Resolution Unmanned Aer- ial System Photography”.

1 Einleitung

Die Drohnen-Fotografie erlaubt es, ein agronomisches Feldexperiment mithilfe von se- quenziellen Fotos zu erfassen (siehe zum Beispiel ROTH & STREIT 2017). Dabei zeigt jedes Foto einen Teilausschnitt des Versuchsfeldes. Bei einem Überflug mit einer ent- sprechend hohen Überlappung entstehen Bilder, die denselben Plot aus unterschiedli- chen Blickwinkeln zeigen (Abbildung 1). Plot-spezifische Blickwinkel können dabei zum Beispiel mithilfe von räumlichen Polarkoordinaten (Polar-Winkel θ und Azimut- Winkel δ) beschrieben werden (Abbildung 2).

Die sichtbare Blattfläche einer Pflanze auf einem Einzelbild hängt wesentlich vom Be- trachtungswinkel ab (Abbildung 3). Diese perspektivischen Effekte können ihre Ursa- che einerseits in der Struktur der experimentellen Plots haben (zum Beispiel Saatrei- hen), andererseits lassen sich auch Rückschlüsse auf die totale Blattfläche ziehen. Da- rauf basierend bildeten wir die Hypothese, dass perspektivische Effekte es erlauben, aus sichtbaren Blattflächen von verschiedenen Einzelbildern auf den Leaf Area Index (LAI) zu schließen.

Abbildung 1: Drei Einzelfotos eines Feldexperimentes auf 30 m Höhe

Abbildung 2: Ein räumliches Polarkoordinaten-System mit Polar-Winkel (θ) und Azimut-Winkel (δ)

Abbildung 3: Simulation einer Sojapflanze (Links: Ansicht in 3D, Mitte: Ansicht von oben, Rechts: Frontansicht)

2 Material und Methoden

Soja diente in dieser Studie als Modellpflanze. Die Drohen-Kampagnen wurden mit ei- nem Quadrokopter (GreenCopter Imager-Quadro DualCam, RUCON Engineering, Großschwabhausen, Deutschland), basierend auf einem Mikrokopter Design (HiSys- tems GmbH, Moormerland, Deutschland) und einer digitalen RGB-Kompaktkamera (Sony RX100 II, DSC-RX100M2, Sony Corporation, Tokio, Japan) gemacht. Die Verar- beitung der Bilder erfolgte gemäß eines individuell entwickelten Workflows in Python zur direkten Verarbeitung von Einzelbildern (Abbildung 4) und wird im Folgenden detaillier- ter erläutert.

Abbildung 4: Workflow zur direkten Verarbeitung von Einzelbildern

2.1 Abschätzung der Kamera-Position und Blickrichtung

Structure-from-Motion (SfM) Techniken erlauben es, die Position und Blickrichtung einer Kamera zum Zeitpunkt der Aufnahme abzuschätzen. Die Einzelbilder einer Flugkam- pagne wurden deswegen zuerst mittels SfM Techniken verarbeitet, wobei definierte Kontrollpunkte am Boden (Ground Control Points, GCP) als Referenz zur räumlichen Positionierung dienten. Als SfM-Software wurde Agisoft Photoscan (Agisoft LLC, St.

Petersburg, Russland) verwendet. Zusätzlich wurde mit Agisoft Photoscan ein digitales Höhenmodell erstellt, das für die spätere Projektion der Bilder verwendet wurde (Abbil- dung 4, links).

2.2 Projektion von Einzelbilder auf das digitale Höhenmodell

Mithilfe der Kamera-Position und eines digitalen Höhenmodells können Einzelbilder auf die Oberfläche des Versuchsfeldes projiziert werden. Die hierzu verwendete Technik wird „Raytracing“ genannt und basiert auf der Simulation von Strahlen von der Kame- raposition in Richtung Oberfläche. Der Schnittpunkt des simulierten Strahles mit der Oberfläche stellt dabei die Position des Bildpixels im Raum dar. Resultat dieses Pro- zesses ist ein Pixel-genau georeferenziertes Einzelfoto (Abbildung 4, Mitte links).

2.3 Extraktion von Plot-basierten Einzelbildern

Aus georeferenzierten Fotos können mittels Plot-Masken individuelle Plot-basierte Ein- zelbilder extrahiert werden (Abbildung 4, Mitte rechts). Dabei führt die Extraktion zu mehreren Einzelbildern desselben Plots, jedes davon mit seinem eigenen spezifischen Betrachtungswinkel auf den Plot.

2.4 Segmentation

Die Plot-basierten Einzelbilder wurden mithilfe des EasyPCC Algorithmus segmentiert (GUO et al. 2017). EasyPCC basiert auf Entscheidungsbaum-Techniken und Transfor- mationen in andere Farbräume.

2.5 Analyse der perspektivischen Effekte

Die vorangehenden Schritte führten zu einer Betrachtungswinkel-abhängigen sichtba- ren Blattfläche. Wenn nun diese Blattflächen-Werte in Abhängigkeit von Polar- und Azi- mut-Winkel dargestellt werden, dann werden spezifische Effekte sichtbar (Abbil- dung 5).

Abbildung 5: Abhängigkeit der sichtbaren Blattfläche von Polar-Winkel (θ) und Azimut-Winkel (δ)

Mit zunehmendem Polar-Winkel nimmt auch die sichtbare Blattfläche zu. Die Abhängig- keit vom Azimut-Winkel zeigt ein Interferenz-Muster sich überlagernder Cosinus-Wellen aufgrund der Orientierung der Saatreihen. Diese zwei Effekte können mittels folgender Formel abgebildet werden:

wobei CC den Bodenbedeckungsgrad (Canopy cover) und LC den lateralen Bede- ckungsgrad (Lateral cover) darstellt, und δr die Azimut-Ausrichtung der Saatreihen. Wird die genannte Formel mittels Regressions-Verfahren auf Blattfläche-Daten angewendet, dann ergeben sich Plot-basierte Schätzungen für CC und LC.

2.6 Schätzung des LAI basierend auf der „Gap fraction theory“

Die „Gap fraction theory“ beschreibt die Wahrscheinlichkeit eines Lichtstrahles mit ei- nem bestimmten Polar-Winkel, einen Pflanzenbestand zu durchqueren, ohne dabei auf Blattfläche zu treffen (NILSON 1971, CAMPBELL & NORMAN 1990). Dieses Konzept lässt sich auf CC und LC Messwerte übertragen und führt somit zu einer LAI-Schätzmethode:

Mithilfe dieser Formel lassen sich somit LAI-Schätzungen anhand von perspektivischen Effekten in RGB-Fotos vornehmen.

3 Resultate

Für zwei Zeitpunkte konnten erfolgreich Bilddaten gesammelt werden und Validie- rungsmessungen mit einem LI-COR 2200 Gerät sowie destruktive Blattfläche- Bestimmungen vorgenommen werden. Die aus den Bildern ermittelten LAI Werte zeig- ten eine gute Korrelation mit LI-COR 2200 Messwerten (R2 = 0.92, RMSE = 0.42 m2m−2) wie auch mit destruktiven Messwerten (R2 = 0.89, RMSE = 0.41 m2m−2).

4 Diskussion und Schlussfolgerung

Wir schliessen aus den Resultaten dass Blattflächenanalysen aufgrund von perspektivi- schen Effekten in RGB-Fotos eine valide Alternative zu Messungen am Boden darstel- len. Es sollte jedoch beachtet werden, dass die neu entwickelte Methode nur für LAI- Bereiche ≤ 3 validiert wurde.

Literaturverzeichnis

CAMPBELL GS, NORMAN JM (1990): The description and measurement of plant canopy struc- ture. In RUSSELL G, MARSHALL B, JARVIS PG, editors, Plant canopies, pages 1–19. Cam- bridge University Press, Cambridge.

GUO W,ZHENG B,DUAN T,FUKATSU T,CHAPMAN S,NINOMIYA S(2017): EasyPCC: Benchmark datasets and tools for high-throughput measurement of the plant canopy coverage ratio un- der field conditions. Sensors, 17(798).

NILSON T (1971): A theoretical analysis of the frequency of gaps in plant stands. Agricultural Meteorology, 8:25–38.

ROTH L, STREIT B (2017): Predicting cover crop biomass by lightweight UAS-based RGB and NIR photography: an applied photogrammetric approach. Precision Agriculture, pp.1–22.

Available at: http://link.springer.com/10.1007/s11119-017-9501-1.

Drohnenbasierte Fernerkundung in der Weizenzüchtung Drone based remote sensing in wheat breeding

Tina Langkamp-Wedde1, Martin Kraft1, Heiko Neeland1, Katja Matschiner2, Lorenz Kottmann3, Siegfried Schittenhelm3

1Thünen-Institut für Agrartechnologie, Bundesallee 47, 38116 Braunschweig;

2Strube Research GmbH & Co. KG, Hauptstraße 1, 38387 Söllingen;

3Julius Kühn-Institut, Institut für Pflanzenbau und Bodenkunde, Bundesallee 58, 38118 Braunschweig;

E-Mail: tina.langkamp-wedde@thuenen.de

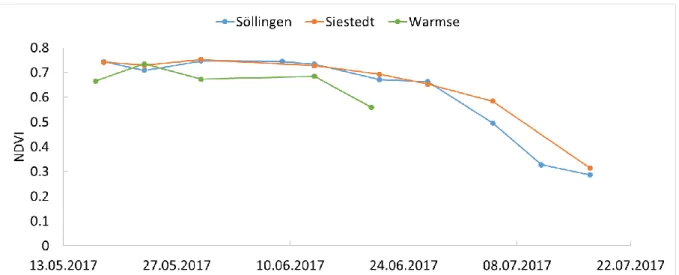

Zusammenfassung: Ziel war es, den Einsatz eines vollständig programmierbaren Mul- tispektralkamerasystems zur Fernerkundung in der Weizenzüchtung zu prüfen. Die Un- tersuchungen wurden in den Jahren 2016 und 2017 durchgeführt. Verwendet wurde dafür ein Multispektralkamerasystem, bestehend aus einer Farbkamera und zwei mo- nochromen Kameras mit schmalen Wellenlängenbandfiltern (650 nm und 850 nm) aus- gestattet. Aus den multispektralen Bildern wurden der normalisierte differenzierte Vege- tationsindex (NDVI) und der bodenkorrigierte Vegetationsindex (SAVI) berechnet. Das gesamte Multispektralkamerasystem wurde in die Trägerplattform „ThünoCopter", ei- nem MK OktoXL 6S12 von „MikroKopter“, mechanisch und elektronisch integriert und in einem Weizenversuch zu unterschiedlichen Entwicklungsstadien zwischen dem Ende der Fahnenblattentwicklung und dem Beginn der Kornreife eingesetzt. Die Versuchsan- lage umfasste 60 Genotypen unterschiedlicher Herkunft sowie vier Referenzgenotypen in dreifacher Wiederholung an drei Standorten. Die Auswertungen ergaben, dass in 2016 zwischen dem im Juni gemessenem NDVI und dem Kornertrag ein signifikanter Zusammenhang vorlag, der mit Berücksichtigung der Blattstellung verbessert werden konnte. Auch lag zwischen dem gemessenen NDVI zu Beginn der Abreife und dem bo- nitierten Tag des Ährenschiebens an allen drei Standorten ein signifikanter Zusammen- hang vor (Söllingen 2016: R² = 0,48***). Beide Zusammenhänge konnten die Untersu- chungen aus 2017 bestätigen.

Deskriptoren: Drohne, Multispektralkamerasystem, Weizenzüchtung, NDVI

Abstract: The aim was to test a fully programmable multispectral camera system for remote sensing in wheat breeding. The examinations were carried out in 2016 and 2017. For this purpose, a multi-spectral camera system was used. One camera was a colour camera and two cameras were monochrome and equipped with narrow wave- length band filters of 650 nm and 850 nm. From the multispectral images, the normal- ized differentiated vegetation index (NDVI) and the soil-adjusted vegetation index (SA-

VI) were calculated. The entire camera system was mechanically and electronically in- tegrated into the carrier platform "ThünoCopter", a MK OktoXL 6S12 from "MikroKop- ter", and used in a wheat trial at various stages of crop growth between the end of flag leaf development and the beginning of grain maturity. The trial included 60 genotypes of different origins and four reference genotypes in three repetitions at three sites. The analysis showed that there was a significant correlation between NDVI measured in June and grain yield in 2016, which could be improved by taking account of leaf orienta- tion. There was also a significant correlation between measured NDVI at the beginning of maturity and the date of ear emergence at all three locations (Söllingen 2016: R² = 0.48***). Both relationships were confirmed by the investigations from 2017.

Keywords: drone, multi-spectral camera system, wheat breeding, NDVI

1 Einleitung

Nicht nur der private Einsatz von Drohnen ist in den letzten Jahren stark angestiegen (STATISTA 2014), sondern auch Pflanzenzüchter zeigen ein großes Interesse an der Dohnentechnik zur Fernerkundung von Zuchtgärten. Zuchtgärten umfassen eine große Anzahl von Genotypen deren Evaluation sehr zeitaufwändig ist (CHAPMAN et al. 2014).

Klassische Messungen und Bonituren der Pflanzenparameter sind sehr zeitintensiv.

Von großem Interesse ist die Bonitur der Reife. Um den exakten Zeitpunkt der Reife zu bestimmen, wird noch bis heute die Fingernagel-Probe an jeder einzelnen Parzelle über mehrere Tage hinweg angewendet (BUNDESSORTENAMT 2000). Mit Hilfe der Fernerkun- dung ist die Messung indirekter Parametern an einer großen Anzahl von Genotypen einfach und schnell durchführbar (PEÑUELAS et al. 1997). Hinzu kommt, dass bei einem Erfolg der Fernerkundung der Zuchtgarten seltener betreten werden muss. Dies redu- ziert die Schädigung von Parzellen (CHAPMAN et al. 2014).

Das Verbundprojekt „Phaenokopter“ war eine groß angelegte Versuchsreihe. Ein Teil- ziel dieses Verbundprojektes war die Analyse von multispektralen Aufnahmen und die Abschätzung züchterisch relevanter Bestandsparameter mit Hilfe fernerkundlicher Ve- getationsindizes. In der vorliegenden Arbeit wird der Einsatz eines vollständig pro- grammierbaren Systems zur Fernerkundung in der Weizenzüchtung geprüft. Dabei werden die Abschätzung züchterisch relevanter Bestandsparameter mit Hilfe des NDVI und des SAVI am Beispiel von drei Zuchtgärten in Söllingen, Siestedt und Warmse vor- gestellt.

2 Material und Methode Trägerplattform

Für die vorliegende Untersuchung wurde die Trägerplattform „ThünoCopter" verwendet.

Der ThünoCopter ist ein modifiziertes unbemanntes Flugsystem, das aus dem MK Ok- toXL 6S12 von MikroKopter (HiSystems GmbH, Moormerland, Deutschland) mit einer

Standard-Multi-Kopter-Navigation entwickelt wurde. Das Gesamtgewicht der Träger- plattform einschließlich der Sensoren betrug 5 kg und sie wurde von einer 10.000 mAh Lithium-Polymer-Batterie für eine Betriebszeit von ca. 20 min angetrieben. Zusätzlich wurde ein roll- und neigungsstabilisierter Gimbal installiert, um optimale orthogonale Aufnahmen zu gewährleisten.

Multispektralkamerasystem

Ausgehend von einer detaillierten Marktuntersuchung wurde in eine 4-Kanal Kamera- plattform von VRmagic (D3, VRmagic GmbH, Mannheim, Deutschland) (VRMAGIC 2016) investiert. Diese Kameraplattform wird mittels eines Linux-Betriebssystems gesteuert und Bilddaten lassen sich auf einer Speicherkarte zwischenspeichern und über eine Ethernet-Schnittstelle auslesen. Jeder Kanal war mit einem Chip des Typs Aptina MT9V024 mit einer Auflösung von 752 x 480 Pixel und einer Empfindlichkeit von 350 bis 1050 nm (ONSEMI 2016) ausgestattet. Diese Chips verfügen über elektronische Glo- bal Shutter.

Auf dieser D3-Plattform können bis zu vier Bildsensoren angeschlossen werden. Für diese Untersuchungen wurden drei Sensoren verwendet, ein RGB-Farbsensor und zwei monochrome Sensoren. Die Sensorplatine für den RGB-Kanal war mit einem RGB- Bayer-Farbfilter und die zwei monochromen Kanäle wurden mit aufschraubbaren hart- beschichteten Bandpassfiltern (Edmund Optics GmbH, Karlsruhe, Deutschland) ausge- stattet. Unter Berücksichtigung der Temperatur- und Winkelabhängigkeit wurden Filter einer zentralen Wellenlänge von 650 und 850 nm mit einer Halbwertsbreite von 50 nm ausgewählt (EDMUND.OPTICS 2016).

Sie dienen im Folgenden zur Berechnung des NDVI und SAVI. Die Urquelle dieser Indi- zes geht auf ROUSE et al. (1974) zurück. Sie verwendeten bei ihren Berechnungen die Bande 2 (600 - 700 nm) und die Bande 4 (800 – 1100 nm) des Satelliten Landsat 4-5 (USGS 2016). Welche genauen Wellenlängen im roten und nah-infraroten Bereich für die Berechnung des NDVI optimal sind, ist nicht bekannt. OLLINGER (2011) berichtet, dass eine bessere Identifizierung möglich ist, wenn Messungen näher in Richtung des grünen Bereichs stattfinden, da dort eine stärkere Differenzierung stattfindet als im ma- ximalen Absorptionsbereich des Chlorophylls bei 670 nm (SITTE et al. 2002). Da zu An- fang der vorliegenden Arbeit noch weitere wasserspezifische Reflexionsindizes berech- net werden sollten, wurde der zweite spektrale Bereich bei 850 nm festgelegt. Die spektrale Reflexion von Getreide und Boden zeigt, dass hier ein NIR-Plateau vorliegt (OLLINGER 2011) und dieses unempfindlich gegenüber Änderungen im Wassergehalt ist (ZARCO-TEJADA et al. 2003).

Das Multispektralkamerasystem wurde zudem durch hochwertige Objektive des Her- stellers Kowa (Kowa Europe GmbH, Düsseldorf, Deutschland) mit einer Brennweite von f = 5 mm und einer Verzeichnung ≤ 0,5% erweitert. Zwei LM5JC1M-Objektive (KOWA

2016a) für die RGB- und 650 nm-Kanäle und ein Breitband LM5JC10M-Objektiv (KOWA

2016b) für den 850 nm-Kanal. Des Weiteren wurde ein Lichtsensor integriert, um die

Sonneneinstrahlung der Umgebung für die Berechnung der Belichtungszeit zu messen.

Die Belichtungszeiten werden an das Kamerasystem weitergeleitet, und Messflüge können auch bei wechselnden Lichtbedingungen durchgeführt werden. Der Kopter und das Kamerasystem sind in Abbildung 1 zu erkennen.

Abbildung 1: Trägerplattform “ThünoCopter“ und die Multisensorkamera VRmagic D3.

Feldversuch

Ziel dieser Arbeit war es, den Einsatz eines voll programmierbaren Multispektralkame- rasystems zur Fernerkundung in der Weizenzüchtung während der Wachstums- und Entwicklungsperiode zu untersuchen. Um dies zu realisieren, wurde das Kamerasystem in einer Gitteranlage (8x8x3) eines Weizenversuchs getestet. Die Versuchsanlage um- fasste 60 Genotypen unterschiedlicher Herkunft sowie vier Referenzgenotypen in drei- facher Wiederholung an zwei Standorten in Niedersachsen (Söllingen und Warmse) und einem Standort in Sachsen-Anhalt (Siestedt). Jede Parzelle hatte eine Größe von ca. 1,25 x 4,00 m (ja nach Arbeitsbreite). Die drei Standorte unterschieden sich in ihrem Bodentyp, ihrer Bodengüte (Tabelle 1) und ihrem pflanzenverfügbaren Bodenwasser.

Die Vorfrüchte waren am Standort Söllingen Winterweizen, am Standort Siestedt Raps und am Standort Warmse Kartoffeln.

Tabelle 1: Bodenzahl und Bodenart der Standorte Warmse, Siestedt und Söllingen in den Versuchsjahren 2016 und 2017.

Jahr Söllingen Siestedt Warmse

2016 98, Lösslehm (L1Lo) 53, Schwerer Lehm (LT) 26, Sand (S4AL) 2017 98, Lösslehm (L1Lo) 55, Schwerer Lehm (LT) 27, Sand (S4AL)

Messungen

Im Versuchsjahr 2016 gab es je vier Messflüge an den Standorten Söllingen und Sies- tedt, die alle zwei Wochen stattfanden. Am Standort Warmse fanden drei Messflüge statt, von denen wegen einer Überbelichtung der Aufnahmen jedoch nur der vom 10.05.2016 auswertbar war. Daraufhin wurde am ThünoCopter der bereits beschriebe-

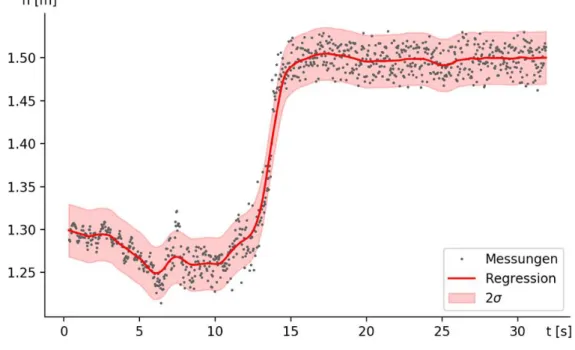

![Abbildung 2: Bodenwassergehalt [Vol.%] der Standorte Söllingen und Warmse in den Versuchsjahren 2016 und 2017 als Mittel über die Gesamtwurzeltiefe](https://thumb-eu.123doks.com/thumbv2/1library_info/4989207.1644497/36.892.116.802.503.825/abbildung-bodenwassergehalt-standorte-söllingen-warmse-versuchsjahren-mittel-gesamtwurzeltiefe.webp)

![Abbildung 6: Zusammenhang zwischen NDVI_Juni und Kornertrag [t ha -1 ] in den Versuchsjah- Versuchsjah-ren 2016 (links) und 2017 (rechts) an den Standorten Söllingen, Siestedt und Warmse](https://thumb-eu.123doks.com/thumbv2/1library_info/4989207.1644497/39.892.98.780.271.494/abbildung-zusammenhang-kornertrag-versuchsjah-versuchsjah-standorten-söllingen-siestedt.webp)

![Abbildung 8: Zusammenhang zwischen der Blattstellung und dem Kornertrag [t ha -1 ] in den Versuchsjahren 2016 (links) und 2017 (rechts) an den Standorten Söllingen, Siestedt und](https://thumb-eu.123doks.com/thumbv2/1library_info/4989207.1644497/41.892.101.778.129.354/abbildung-zusammenhang-blattstellung-kornertrag-versuchsjahren-standorten-söllingen-siestedt.webp)