H¨ ohere Mathematik 2 - Kompakt

Themen:

Lineare Algebra

Analysis mehrerer Ver¨ anderlichen

Inhaltsverzeichnis

4 Lineare Algebra 69

4.1 Grundlegende Strukturen . . . . 71

4.1.1 Gruppen und K¨orper . . . . 71

4.1.2 Vektorr¨aume . . . . 73

4.1.3 Skalarprodukt und Norm . . . . 74

4.1.4 Basen . . . . 76

4.2 Matrizen . . . . 77

4.2.1 Lineare Abbildungen . . . . 77

4.2.2 Matrix-Operationen . . . . 79

4.2.3 Spezielle Matrizen . . . . 80

4.2.4 Determinanten . . . . 81

4.3 Lineare Gleichungssysteme . . . . 83

4.3.1 Klassifikation und allgemeine Struktur . . . . 83

4.3.2 Direkte Methoden . . . . 84

4.3.3 Ausgleichsprobleme . . . . 86

4.4 Normalformen . . . . 87

4.4.1 Eigenwerte und Eigenvektoren . . . . 87

4.4.2 Diagonalisierung . . . . 88

4.4.3 Jordan-Normalform . . . . 89

4.4.4 Singul¨arwertzerlegung . . . . 90

4.5 Analytische Geometrie . . . . 91

4.5.1 Orthogonale Gruppen . . . . 91

4.5.2 Quadriken . . . . 92

5 Analysis mehrerer Ver¨ anderlichen 95 5.1 Grundbegriffe . . . . 97

5.1.1 Mengen . . . . 97

5.1.2 Funktionen . . . . 98

5.1.3 Stetigkeit . . . . 99

5.1.4 Konvergenz . . . 100

5.2 Differentiation . . . 101

5.2.1 Mypartielle Ableitungen . . . 101

5.2.2 Ableitungsregeln . . . 103

5.2.3 Taylor-Entwicklung . . . 104

5.2.4 Extremwerte . . . 105

5.3 Mehrdimensionale Integration . . . 106

5.3.1 Mehrdimensionale Integrale . . . 106

5.3.2 Variablentransformation . . . 107

5.3.3 Kurven- und Fl¨achenintegrale . . . 108

5.3.4 Anwendungen . . . 110

5.3.5 Integrals¨atze . . . 111

Teil 4

Lineare Algebra

4.1 Grundlegende Strukturen

4.1.1 Gruppen und K¨ orper

Gruppe

Menge G mit bin¨arer Operation : G × G 7−→ G

• Assoziativit¨at: (a b) c = a (b c)

• Neutrales Element: ∃! e ∈ G: e a = a e = a

• Inverses Element: a a

−1= a

−1a = e

kommutativ oder abelsch ⇔ a b = b a Untergruppe

Teilmenge U einer Gruppe G

abgeschlossen unter der Gruppenoperation von G, d.h.

a, b ∈ U = ⇒ a b ∈ U, a ∈ U = ⇒ a

−1∈ U

Permutationen und symmetrische Gruppe

Gruppe S

nder Bijektionen auf {1, 2, . . . , n}

π =

1 2 3 . . . n

π(1) π(2) π(3) . . . π(n)

n! Elemente

Zyklenschreibweise von Permutationen

Zyklus: Bilder eines Elementes bei mehrfacher Ausf¨uhrung der Permutation Zerlegung von π ∈ S

n, z.B.

π =

1 2 3 4 5 6 4 3 2 6 5 1

≡ (1 4 6) (2 3) (5) bzw. π = (1 4 6) (2 3)

Transposition und Signum einer Permutation τ = (j k): Vertauschung von j und k

Produktdarstellung von Permutationen

π = τ

1◦ · · · ◦ τ

mVorzeichen (Signum) einer Permutation: σ(π) = (−1)

mK¨ orper

Menge K , auf der eine Addition + und eine Multiplikation · definiert sind

• (K, +): abelsche Gruppe mit neutralem Element 0

a + b = b + a (a + b) + c = a + (b + c)

a + 0 = a a + (−a) = 0

• (K\{0}, ·): abelsche Gruppe mit neutralem Element 1 a · b = b · a (a · b) · c = a · (b · c)

a · 1 = a a · a

−1= 1

• Distributivgesetz: a · (b + c) = a · b + a · c Primk¨ orper

Z

p= {0, 1, . . . , p − 1}, p : Primzahl K¨orper unter Addition und Multiplikation modulo p

Chinesischer Restsatz Kongruenzen

x = a

1mod p

1. . .

x = a

nmod p

neindeutige L¨osung x ∈ {0, . . . , P − 1}, P = p

1· · · p

n, f¨ur teilerfremde Zahlen p

1, . . . , p

nx =

n

X

k=1

a

kQ

k(P/p

k) mod P, Q

k(P/p

k) = 1 mod p

k4.1.2 Vektorr¨ aume

Vektorraum

abelsche Gruppe (V, +), auf der eine Skalarmultiplikation · mit Elementen aus einem K¨orper K mit den folgenden Eigenschaften definiert ist

(λ

1+ λ

2) · v = λ

1· v + λ

2· v λ · (v

1+ v

2) = λ · v

1+ λ · v

2(λ

1· λ

2) · v = λ

1· (λ

2· v) 1 · v = v

Vektorraum der n-Tupel

K

n: a =

a

1...

a

n

= (a

1, . . . , a

n)

t, a

i∈ K komponentenweise definierte Addition und Skalarmultiplikation

a

1...

a

n

+

b

1...

b

n

=

a

1+ b

1...

a

n+ b

n

, λ ·

a

1...

a

n

=

λ · a

1...

λ · a

n

R

n( C

n): n-Tupel reeller (komplexer) Zahlen Unterraum

Teilmenge U eines K -Vektorraums V , die bzgl. der Addition und Skalarmultiplikation abgeschlossen ist:

u, v ∈ U = ⇒ u + v ∈ U λ ∈ K, u ∈ U = ⇒ λ · u ∈ U Linearkombination

λ

1· v

1+ λ

2· v

2+ · · · + λ

m· v

m=

m

X

i=1

λ

i· v

ilineare H¨ulle span(U ): Menge aller Linearkombinationen von Elementen aus U Konvexkombination

λ

1v

1+ λ

2v

2+ · · · + λ

mv

m, λ

i≥ 0, X

i

λ

i= 1

konvexe H¨ulle conv(U ): Menge aller Konvexkombinationen von Vektoren aus U

4.1.3 Skalarprodukt und Norm

Reelles Skalarprodukt

Bilinearform h·, ·i : V × V → R auf einem reellen Vektorraum V mit folgenden Eigenschaften

• Positivit¨at:

hv, vi > 0 f¨ur v 6= 0

• Symmetrie:

hu, vi = hv, ui

• Linearit¨at:

hλu + %v, wi = λhu, wi + %hv, wi Skalarprodukt reeller Vektoren

v

tw = v

1w

1+ · · · + v

nw

n= |v||w| cos α mit α ∈ [0, π] dem kleineren der beiden Winkel zwischen v und w assoziierte Norm

|v| = q

v

12+ · · · + v

2nKomplexes Skalarprodukt

Abbildung h·, ·i : V × V → C auf einem komplexen Vektroraum V mit folgenden Eigenschaften

• Positivit¨at:

hv, vi > 0 f¨ur v 6= 0

• Schiefsymmetrie:

hu, vi = hv, ui

• Linearit¨at:

hλu + %v, wi = λhu, wi + %hv, wi Skalarprodukt komplexer Vektoren

y

∗x = x

1y ¯

1+ · · · + x

ny ¯

nassoziierte Norm

|z| = p

|z

1|

2+ · · · + |z

n|

2Cauchy-Schwarz-Ungleichung

|hu, vi| ≤ |u||v|, |w| = p hw, wi Gleichheit genau dann wenn u k v

bei reellem Skalarprodukt Definition eines Winkels α ∈ [0, π] via

hu, vi

Norm

Abbildung k · k : V → R mit den folgenden Eigenschaften

• Positivit¨at:

kvk > 0 f¨ur v 6= 0

• Homogenit¨at:

kλvk = |λ|kvk

• Dreiecksungleichung:

ku + vk ≤ kuk + kvk Norm, assoziiert mit einem Skalarprodukt

|u| = p

hu, vi

4.1.4 Basen

Lineare Unabh¨ angigkeit linear unabh¨angig:

α

1v

1+ · · · + α

mv

m= 0 = ⇒ α

1= · · · = α

n= 0 linear abh¨angig:

∃(α

1, . . . , α

n) 6= 0 : α

1v

1+ · · · + α

mv

m= 0 (nicht-triviale Darstellung des Nullvektors)

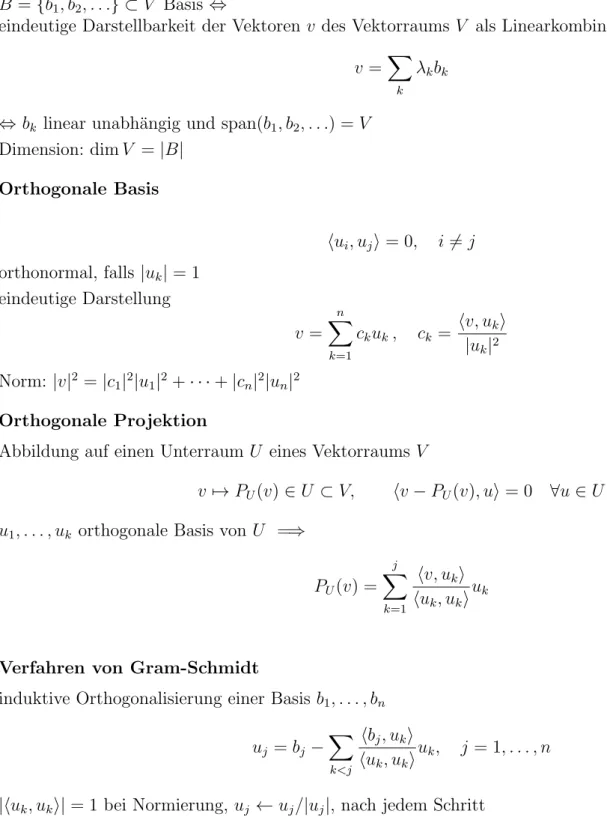

Basis

B = {b

1, b

2, . . .} ⊂ V Basis ⇔

eindeutige Darstellbarkeit der Vektoren v des Vektorraums V als Linearkombination v = X

k

λ

kb

k⇔ b

klinear unabh¨angig und span(b

1, b

2, . . .) = V Dimension: dim V = |B|

Orthogonale Basis

hu

i, u

ji = 0, i 6= j orthonormal, falls |u

k| = 1

eindeutige Darstellung

v =

n

X

k=1

c

ku

k, c

k= hv, u

ki

|u

k|

2Norm: |v|

2= |c

1|

2|u

1|

2+ · · · + |c

n|

2|u

n|

2Orthogonale Projektion

Abbildung auf einen Unterraum U eines Vektorraums V

v 7→ P

U(v) ∈ U ⊂ V, hv − P

U(v), ui = 0 ∀u ∈ U u

1, . . . , u

korthogonale Basis von U = ⇒

P

U(v) =

j

X

k=1

hv, u

ki hu

k, u

ki u

kVerfahren von Gram-Schmidt

induktive Orthogonalisierung einer Basis b

1, . . . , b

nu

j= b

j− X

k<j

hb

j, u

ki

hu

k, u

ki u

k, j = 1, . . . , n

|hu

k, u

ki| = 1 bei Normierung, u

j← u

j/|u

j|, nach jedem Schritt

4.2 Matrizen

4.2.1 Lineare Abbildungen

Lineare Abbildung

Abbildung L : V → W zwischen Vektorr¨aumen

• additiv:

L(u + v) = L(u) + L(v)

• homogen:

L(λv) = λL(v)

insbesondere: L(0

V) = 0

W, L(−v) = −L(v) Komposition linearer Abbildungen

Hintereinanderausf¨uhrung linearer Abbildungen S : U → V , T : V → W lineare Abbildung

T ◦ S : U → W, (T ◦ S)(u) = T (S(u)) Matrix

Rechteckschema mit m Zeilen und n Spalten

A = (a

ij) =

a

11a

12· · · a

1na

21a

22· · · a

2n... ... ...

a

m1a

m2· · · a

mn

komponentenweise Definition von Operationen

C = A ± B ⇔ c

ij= a

ij± b

ij, B = λA ⇔ b

ij= λa

ijMatrix einer linearen Abbildung

lineare Abbildung L : V 7−→ W zwischen Vektorr¨aumen mit Basen E = {e

1, . . . , e

n} und F = {f

1, . . . , f

m} eindeutig bestimmt durch die Bilder der Basisvektoren

L(e

j) = a

1,jf

1+ · · · + a

m,jf

mlineare Abbildung der Koordinaten

w

F= Av

E⇔ w

i=

n

X

j=1

a

i,jv

j, i = 1, . . . , m

Basiswechsel

Transformation der Koordinaten bei einem Basiswechsel E → E

0v

E0= Av

E, e

k= X

j

a

jke

0jBild und Kern

lineare Abbildung L : V → W

Kern L = {v ∈ V : L(v) = 0} ⊆ V

Bild L = {w ∈ W : ∃v ∈ V mit L(v) = w} ⊆ W dim V < ∞ = ⇒

dim V = dim Kern(L) + dim Bild(L) Inverse Abbildung

L : V → W injektiv ⇔ Kern L = 0

Vlineare Umkehrabbildung

w 7→ v, w = L(v)

4.2.2 Matrix-Operationen

Matrix-Multiplikation

A : m × n, B : n × ` C : m × `

C = AB, c

ik=

n

X

j=1

a

ijb

jk, 1 ≤ i ≤ m, 1 ≤ k ≤ ` Komposition der linearen Abbildungen u 7→ v = Bu, v 7→ w = Av

i.a. nicht kommutativ Inverse Matrix

AA

−1= A

−1A = E Invertierung von Matrixprodukten: (AB)

−1= B

−1A

−1Transponierte, adjungierte, symmetrische und hermitesche Matrix transponierte Matrix

B = A

t⇔ b

i,j= a

j,isymmetrisch: A = A

tadjungierte Matrix

C = A

∗= ¯ A

t⇔ c

i,j= ¯ a

j,iselbst-adjungiert oder Hermitesch: A = A

∗Regeln

(AB)

t= B

tA

tund (AB)

∗= B

∗A

∗, (A

t)

−1= (A

−1)

tund (A

∗)

−1= (A

−1)

∗Spur einer Matrix

Spur(A) =

n

X

k=1

a

kkRegeln

Spur(AB) = Spur(BA), Spur(T

−1AT ) = Spur(A) Rang einer Matrix

maximale Anzahl linear unabh¨angiger Spalten bzw. Zeilen Matrix-Norm

zugeordnet

kAk = sup

x6=0

kAxk

kxk = max

kxk=1

kAxk submultiplikativ, d.h. kABk ≤ kAkkBk

euklische Norm

kAk

2= max{ √

λ : A

∗Av = λv}

Zeilensummennorm

kAk

∞= max

j

X

k

|a

jk|

4.2.3 Spezielle Matrizen

Orthogonale und unit¨ are Matrix unit¨ar: Spalten bilden orthonormale Basis

A

−1= A

t= A

∗orthogonal: Spezialfall reeller Matrizen, A

−1= A

tInvarianz der euklidischen Norm: |Av| = |v|

Normale Matrizen

A normal ⇔ AA

∗= A

∗A, A

∗= ¯ A

tbzw. AA

t= A

tA f¨ur reelles A

unit¨ar, hermitesch, orthogonal oder symmetrisch = ⇒ normal Zyklische Matrizen

generiert durch zyklisches Verschieben der ersten Spalte

a

0a

n−1a

n−2. . . a

1a

0a

n−1. . . a

2a

1a

0. . .

... ... ...

zyklische Struktur kompatibel mit Matrixmultiplikation Positiv definite Matrix

v

∗Av > 0 ∀v 6= 0

positive Diagonalelemente und Eigenwerte, positiv definite Inverse

semidefinit, falls v

∗Av ≥ 0

4.2.4 Determinanten

Determinante

Schreibweisen

det A = det(a

1, . . . , a

n) = |A| =

a

11· · · a

1n... ...

a

n1· · · a

nnmit a

kden Spalten von A

definierende Eigenschaften

• Multilineari¨at:

det(. . . , αa

j+ βb

j, . . .) = α det(. . . , a

j, . . .) + β det(. . . , b

j, . . .)

• Antisymmetrie:

det(. . . , a

j, . . . , a

k, . . .) = − det(. . . , a

k, . . . , a

j, . . .)

• Normierung:

det(e

1, . . . , e

n) = 1 , (e

k)

`= δ

k`f¨ur die Einheitsvektoren e

kEntwicklung als Summe n-facher Produkte

det A = X

i∈Sn

σ(i) a

i1,1· · · a

in,nmit σ(i) dem Vorzeichen der Permutation (i

1, . . . , i

n) Eigenschaften von Determinanten

det A

• invariant bei Addition eines Vielfachen einer Spalte (Zeile) zu einer anderen Spalte (Zeile)

• null bei zwei gleichen Spalten (Zeilen)

• Vorzeichen¨anderung bei Vertauschung von Spalten (Zeilen) sukzessive Transformation auf Dreiecksform

Regeln

detA = detA

t, det(A

-1) = (detA)

−1, det(AB) = (detA)(detB)

Determinante als Volumen

Volumen des von a

1, . . . , a

naufgespannten Spats

| det A| = vol (

nX

i=1

α

ia

i: 0 ≤ α

i≤ 1 )

= vol (A[0, 1]

n)

Determinanten spezieller Matrizen

• Dreiecksmatrix: a

ij= 0 f¨ur i < j oder i > j = ⇒

det A = a

11· · · a

nn• Blockdiagonalmatrix: Blockstruktur mit A

ij= 0, i 6= j, und quadratischen Diagonalbl¨ocken A

ii= ⇒ det A =

k

Y

i=1

det A

ii• Orthogonale und unit¨are Matrizen:

| det U | = 1 Entwicklungssatz f¨ ur Determinanten

det A =

n

P

j=1

(−1)

k+ja

kjdet ˜ A

kj(Entwicklung nach Zeile k)

=

n

P

i=1

(−1)

i+`a

i`det ˜ A

i`(Entwicklung nach Spalte l)

mit ˜ A

ijder Matrix, die durch Streichen der i-ten Zeile j -ten Spalte entsteht

4.3 Lineare Gleichungssysteme

4.3.1 Klassifikation und allgemeine Struktur

Lineares Gleichungssystem

a

1,1x

1+ · · · + a

1,nx

n= b

1... ... ... ... ... ...

a

m,1x

1+ · · · + a

m,nx

n= b

m⇔ Ax = b homogen (inhomogen): b = 0 (b 6= 0)

uberbestimmt, falls unl¨osbar (im Allgemeinen f¨ur ¨ m > n)

unterbestimmt, falls keine eindeutige L¨osung (im Allgemeinen f¨ur m < n) L¨ osungsmenge eines linearen Gleichungssystems

Ax = a

1x

1+ · · · a

nx

n= b ∈ R

mmit a

kden Spalten von A

(i) homogenenes System (b = 0):

immer l¨osbar, linearer L¨osungsraum Kern A

eindeutige L¨osung x = 0, falls a

klinear unabh¨angig (ii) inhomogenes System (b 6= 0):

l¨osbar genau dann wenn b ∈ Bild A (b als Linearkombination von a

kdarstellbar) affiner L¨osungsraum

x

∗+ Kern A mit einer speziellen L¨osung x

∗eindeutig, falls Kern A = 0

4.3.2 Direkte Methoden

Cramersche Regel

Ax = b ⇔ x

idet A = det(a

1, . . . , a

i−1, b, a

i+1, . . . , a

n) mit a

kden Spalten der quadratischen Matrix A

eindeutige L¨osung f¨ur belibieges b, falls det A 6= 0

b = e

j(Einheitsvektoren) Koeffizienten der Inversen C = A

−1c

i,j= det(a

1, . . . , a

i−1, e

j, a

i+1, . . . , a

n) det A

R¨ uckw¨ arts-Einsetzen

r

1,1· · · r

1,n. .. ...

0 r

n,n

x

1...

x

n

=

b

1...

b

n

sukzessive Berechnung der Unbekannten

x

`= (b

`− r

`,`+1x

`+1− · · · − r

`,nx

n) /r

`,`, ` = n, . . . , 1

Gauß-Elimination

Transformation auf obere Dreiecksform nach ` − 1 Schritten

a

1,1x

1+ a

1,2x

2+ . . . + a

1,`x

`+ . . . + a

1,nx

n= b

1a

2,2x

2+ . . . + a

2,`x

`+ . . . + a

2,nx

n= b

2... ... ...

a

`,`x

`+ . . . + a

`,nx

n= b

`a

`+1,`x

`+ . . . + a

`+1,nx

n= b

`+1... ... ...

a

n,`x

`+ . . . + a

n,nx

n= b

n`-ter Eliminationsschritt

• evtl. Vertauschung von Zeilen, so dass a

`,`6= 0

• Subtraktion von Vielfachen der `-ten Zeile:

f¨ur i > ` und j ≥ `

a

i,j← a

i,j− q

ia

`,j, b

i← b

i− q

ib

`(q

i= a

i,`/a

`,`)

Zeilenstufenform eines Gleichungssystems

Ax = b ⇔

0...0 p

1∗...∗

0 0...0 p

2∗...∗

0 0...0 p

3∗...

. ..

x

1...

x

n

=

c

1...

c

m

mit Pivots p

1, . . . , p

k6= 0, k = Rang A

sukzessive Umformung analog zur Gauß-Elimination

L¨ osung eines linearen Gleichungssystems in Zeilenstufenform

0 . . . 0 p

1∗ . . . ∗

0 0 . . . 0 p

2∗ . . . ∗

0 0 . . . 0 p

3∗ . . . ∗ . ..

x

1...

x

n

=

c

1...

c

m

mit Pivots p

1, . . . , p

k6= 0

l¨osbar genau dann wenn c

k+1= · · · = c

m= 0 (i) k = n eindeutige L¨osung

(ii) k < n n − k linear unabh¨angige L¨osungen des homogenen linearen Gleichungssystems (c

i= 0)

Unbekannte, die den Spalten ohne Pivots entsprechen, frei w¨ahlbar

4.3.3 Ausgleichsprobleme

Ausgleichsgerade

lineare Approximation von Daten (t

k, f

k) durch Minimierung der Fehlerquadratsumme

n

X

k=1

(f

k− p(t

k))

2, p(t) = u + vt

eindeutig l¨osbar bei mindestens zwei verschiedenen Abszissen t

iu = ( P t

2i)( P

f

i) − ( P t

i)( P

t

if

i) n( P

t

2i) − ( P

t

i)

2, v = n( P

t

if

i) − ( P t

i)( P

f

i) n( P

t

2i) − ( P t

i)

2Normalengleichungen

|Ax − b| → min ⇔ A

tAx = A

tb

eindeutige L¨osung x, falls die Spalten von A linear unabh¨angig sind

4.4 Normalformen

4.4.1 Eigenwerte und Eigenvektoren

Eigenwert, Eigenvektor und Eigenraum

Eigenvektor v zum Eigenwert λ einer quadratischen Matrix A Av = λv, v 6= 0 Eigenraum: V

λ= Kern(A − λE)

Ahnlichkeitstransformation ¨ Basiswechsel

A → B = Q

−1AQ erh¨alt Eigenwerte

v Eigenvektor von A ⇔ w = Q

−1v Eigenvektor von B Charakteristisches Polynom

p

A(λ) = det(A − λE) =

a

11− λ a

12. . . a

1na

21a

22− λ . . . a

2n... ... . .. ...

a

n1a

n2. . . a

nn− λ

= (λ

1− λ) · · · (λ

n− λ) Eigenwerte λ

k: Nullstellen von p

An

X

k=1

λ

k= Spur A,

n

Y

k=1

λ

k= det A

Eigenvektoren v: nicht-triviale L¨osungen des homogenen linearen Gleichungssystems (A − λE)v = 0

Konstruktion einer Basis f¨ur den Eigenraum V

λ= Kern(A − λE) durch Transformation auf Zeilenstufen- form

Algebraische und geometrische Vielfachheit

algebraische Vielfachheit m

λ: Ordnung der Nullstelle des charakteristischen Polynoms p

A(λ) = det(A − λE

n)

geometrische Vielfachheit d

λ: Dimension des Eigenraums V

λ= Kern(A − λE

n) Beziehungen zwischen m und d

d

λ≤ m

λ, X

λ

m

λ= n, d

λ= n − Rang(A − λE )

4.4.2 Diagonalisierung

Basis aus Eigenvektoren

Basis aus Eigenvektoren v

kmit Eigenwerten λ

kzu A Diagonalisierung V

−1AV = diag(λ

1, . . . , λ

n), V = (v

1, . . . , v

n)

Diagonalisierung zyklischer Matrizen Eigenvektoren: Spalten der Fourier-Matrix

W = (w

jk)

j,k=0,...,n−1, w = exp(2πi/n) Diagonalform

1 n W

a

0a

n−1· · · a

1a

1a

0· · · a

2... . .. ...

a

n−1a

n−2· · · a

0

W =

λ

1· · · 0 ... ... ...

0 · · · λ

n

mit den Eigenwerten

λ

`=

n−1

X

k=0

a

kw

−k`, ` = 0, . . . , n − 1

Unit¨ are Diagonalisierung A normal, d.h. A

∗A = AA

∗⇔

U

−1AU = diag(λ

1, . . . , λ

n)

mit einer unit¨aren Matrix U (Spalten: orthonormale Basis aus Eigenvektoren) Diagonalisierung hermitescher Matrizen

A = A

∗= ⇒ reelle Eigenwerte und Orthonormalbasis aus Eigenvektoren u

kU

∗AU = diag(λ

1, . . . , λ

n), U = (u

1, . . . , u

n) hermitesch ⇔ symmetrisch f¨ur reelle Matrizen

Rayleigh-Quotient

S hermitesch positiv definit = ⇒

r

S(x) = x

∗Sx

x

∗x , x 6= 0

f¨ur kleinsten und gr¨oßten Eigenwert extremal

4.4.3 Jordan-Normalform

Jordan-Form

Ahnlichkeitstranformation auf die Blockdiagonalform ¨

J =

J

10

. ..

0 J

k

= Q

−1AQ, J

i=

λ

i1 0

0 λ

i1 . .. ...

λ

i1

0 λ

i

mit λ

iden Eigenwerten von A

Konvergenz von Matrix-Potenzen A

n→ 0 ⇔ |λ

k| < 1 ∀k

A

nbeschr¨ankt ⇔ |λ

k| ≤ 1 ∀k und |λ

k| = 1 nur f¨ur Eigenwerte mit gleicher algebraischer und geome- trischer Vielfachheit

Divergenz von A

nin allen anderen F¨allen

4.4.4 Singul¨ arwertzerlegung

Singul¨ arwert-Zerlegung

U

∗AV = S =

s

10

s

20 . ..

, s

1≥ · · · ≥ s

k> s

k+1= · · · = 0 mit k = Rang A

singul¨are Werte s

j: Wurzeln der Eigenwerte von A

∗A

Spalten u

jvon U und v

jvon V : orthonormale Basen aus Eigenvektoren von AA

∗bzw. A

∗A Av

j= s

ju

j, Ax =

k

X

i=1

s

i(v

∗ix)u

iPseudo-Inverse

A

+= V S

+U

∗, S

+= diag(1/s

1, . . . , 1/s

k, 0, . . . , 0) mit s

i> 0 den Singul¨arwerten von A

x = A

+b: Minimum-Norm-L¨osung des Ausgleichsproblems |Ax − b| → min

4.5 Analytische Geometrie

4.5.1 Orthogonale Gruppen

Spiegelung

(orthogonale) Spiegelungsmatrix

Q = E − 2

|d|

2dd

tmit d einem Normalenvektor der Spiegelungsebene

Drehung

Drehung um den Winkel ϕ in der x

ix

j-Ebene Drehmatrix Q

i,jZeile i → Zeile j →

1 0

. ..

c −s

. ..

s c

. ..

0 1

mit c = cos ϕ und s = sin ϕ Q orthogonal, det Q = 1 = ⇒

Q = Y

i<j

Q

i,jDrehung im Raum

x 7→ Qx = cos ϕ x + (1 − cos ϕ)uu

tx + sin ϕ u × x

mit normierter Drehachsenrichtung u, Drehwinkel ϕ (orientiert wie eine Rechtsschraube) und × dem Kreuzprodukt

Qu = u, cos ϕ = (Spur Q − 1)/2 entsprechende Drehmatrix

Q : q

ik= cos ϕ δ

ik+ (1 − cos ϕ) u

iu

k+ sin ϕ X

j

ε

ijku

j4.5.2 Quadriken

Quadrik

Q : x

tAx + 2b

tx + c = 0 homogene Form: Q : ˜ x

tA˜ ˜ x = 0 mit

A ˜ =

c b

tb A

, x ˜

t= (1, x

1, . . . , x

n) Klassifizierung

• kegelige Quadrik: Rang ˜ A = Rang A

• Mittelpunktsquadrik: Rang ˜ A = Rang A + 1

• parabolische Quadrik: Rang ˜ A = Rang A + 2

Hauptachsentransformation

Drehung und Verschiebung Normalform x

tAx + 2b

tx + c =

m

X

i=1

λ

iw

2i+ 2βw

m+1+ γ , x = U w + v mit m = Rang A und βγ = 0

Spalten der Drehmatrix U : Eigenvektoren u

i(Hauptachsen) zu den Eigenwerten λ

ivon A Verschiebungsvektor v: Mittelpunkt der Quadrik

Kegelschnitt

Doppel-Kegel mit Spitze p (p

36= 0), Richtung v und ¨ Offnungswinkel α K : (x − p)

tv = ± cos α

2 |x − p||v | Schnitt mit der Ebene E : x

3= 0 ebene Quadrik

Typ bestimmt durch Winkel β der Achse mit der Ebene E

Euklidische Normalformen der zweidimensionalen Quadriken

• Kegelige Quadriken

Normalform Bezeichnung

x21 a21

+

xa2222

= 0 Punkt

x21 a21

−

xa2222

= 0 schneidendes Geradenpaar

x21

a21

= 0 Doppelgerade

• Mittelpunktsquadriken

Normalform Bezeichnung

x21 a21

+

xa2222

+ 1 = 0 (leere Menge)

x21 a21

−

xa2222

+ 1 = 0 Hyperbel

−

xa212 1−

xa2222

+ 1 = 0 Ellipse

x21

a21

+ 1 = 0 (leere Menge)

−

xa2121

+ 1 = 0 paralleles Geradenpaar

• Parabolische Quadriken Normalform Bezeichnung

x21

a21

+ 2x

2= 0 Parabel

Euklidische Normalformen der dreidimensionalen Quadriken

• Kegelige Quadriken

Normalform Bezeichnung

x21 a21

+

xa2222

+

xa2323

= 0 Punkt

x21 a21

+

xa2222

−

xa2323

= 0 (Doppel-)Kegel

x21 a21

+

xa2222

= 0 Gerade

x21 a21

−

xa2222

= 0 schneidende Ebenen

x21

a21

= 0 Doppelebene

• Mittelpunktsquadriken

Normalform Bezeichnung

x21 a21

+

xa2222

+

xa2323

+ 1 = 0 (leere Menge)

x21 a21

+

xa2222

−

xa2323

+ 1 = 0 zweischaliges Hyperboloid

x21 a21

−

xa2222

−

xa2323

+ 1 = 0 einschaliges Hyperboloid

−

xa212 1−

xa222 2−

xa2323

+ 1 = 0 Ellipsoid

x21 a21

+

xa2222

+ 1 = 0 (leere Menge)

x21 a21

−

xa2222

+ 1 = 0 hyperbolischer Zylinder

−

xa212 1−

xa2222

+ 1 = 0 elliptischer Zylinder

x21

a21

+ 1 = 0 (leere Menge)

−

xa2121

+ 1 = 0 parallele Ebenen

• Parabolische Quadriken

Normalform Bezeichnung

x21 a21

+

xa2222

+ 2x

3= 0 elliptisches Paraboloid

x21 a21

−

xa2222

+ 2x

3= 0 hyperbolisches Paraboloid

x21

a21

+ 2x

2= 0 parabolischer Zylinder

Teil 5

Analysis mehrerer Ver¨ anderlichen

5.1 Grundbegriffe

5.1.1 Mengen

Umgebung

ε-Umgebung eines Punktes x ∈ R

n:

B

ε(x) = {y : |y − x| < ε}

Umgebung U von x: Menge, die eine ε-Umgebung von x enth¨alt Offene Menge

D offen

⇔ jeder Punkt in D besitzt eine Umgebung in D

⇔ Komplement von D abgeschlossen Inneres

◦

D einer (beliebigen) Menge D: alle Punkte in D mit einer Umgebung in D Abgeschlossene Menge

D abgeschlossen

⇔ jede konvergente Folge von Punkten in D besitzt einen Grenzwert in D

⇔ Komplement von D offen

Abschluss D einer (beliebigen) Menge D: Menge aller Grenzwerte von Folgen in D Rand einer Menge

∂D = D \ D

◦Punkte, die keine Umgebung besitzen, die ganz in D oder im Komplement von D liegt Kompakte Menge

kompakt ⇔ beschr¨ankt und abgeschlossen

¨aquivalente Charakterisierungen

• Jede Folge in D besitzt eine konvergente Teilfolge mit Grenzwert in D.

• Jede ¨ Uberdeckung von D mit offenen Mengen besitzt eine endliche Teil¨uberdeckung.

5.1.2 Funktionen

Multivariate Funktionen

f : R

n⊇ D → R

m, x 7→ f (x) skalar- (m = 1) oder vektorwertig (m > 1)

Graph: {(x, f(x)) : x ∈ D}

Niveaufl¨achen: {x ∈ D : f(x) = c}

Multivariate Polynome

p(x) = X

α

a

αx

α, x

α= x

α11· · · x

αnn, α

i∈ N

0totaler Grad ≤ m: P

α ≤ m, Dimension

m+nnmaximaler Grad ≤ m: max

kα

k≤ m, Dimension (m + 1)

nhomogen vom Grad m: P

α = m, Dimension

m+n−1n−15.1.3 Stetigkeit

Stetigkeit multivariater Funktionen

D 3 x

k→ x = ⇒ lim

k→∞

f (x

k) = f(x) Extremwerte stetiger Funktionen

Existenz von Minimum und Maximum auf einer kompakten Menge Aquivalenz von Vektornormen ¨

c

1kxk ≤ |x| ≤ c

2kxk ∀x ∈ R

n5.1.4 Konvergenz

Konvergenz einer Vektor-Folge

k→∞

lim x

k= x bzw. x

k→ x f¨ur k → ∞ ⇔

∀ε > 0 ∃k

ε: |x

k− x| < ε f¨ur k > k

ε⇔ Konvergenz aller Komponenten

Cauchy-Kriterium f¨ ur Vektor-Folgen

∀ε > 0 ∃k

ε: |x

`− x

k| < ε f¨ur `, k > k

ε⇔ Cauchy-Konvergenz aller Komponenten Kontrahierende Abbildung

g : D → D, kg(x) − g(y)k ≤ c kx − yk ∀x, y ∈ D mit Kontraktionskonstante c < 1

f¨ur konvexe Mengen

c ≤ sup

x∈D

||g

0(x)||

mit g

0der Jacobi-Matrix Banachscher Fixpunktsatz

g: kontrahierende Selbstabbildung einer nichtleeren abgeschlossenen Menge D ⊂ R

n, d.h.

• D = D

• x ∈ D = ⇒ g(x) ∈ D

• kg(x) − g(y)k ≤ ckx − yk ∀x, y ∈ D mit c < 1

= ⇒ Existenz eines eindeutigen Fixpunktes x

∗= g(x

∗) ∈ D lineare Konvergenz einer Iterationsfolge (x

`)

kx

∗− x

`k ≤ c

`1 − c kx

1− x

0k

5.2 Differentiation

5.2.1 Mypartielle Ableitungen

Mypartielle Ableitungen

∂

if = f

xi= ∂f

∂x

i, ∂

if(x) = lim

h→0

f(. . . , x

i+ h, . . .) − f(. . . , x

i, . . .) h

Ableitung der univariaten Funktion x

i7→ f (x

1, . . . , x

i, . . . , x

n), bei der die Variablen x

j, j 6= i, als Kon- stanten betrachtet werden

Mehrfache mypartielle Ableitungen

∂

i∂

jf = f

xjxi= ∂

2f

∂x

i∂x

jMultiindex-Notation

∂

αf = ∂

1α1· · · ∂

nαnf, α = (α

1, . . . , α

n), α

i∈ N

0∂

i∂

jf = ∂

j∂

if¨ur glatte Funktionen f Totale Ableitung und Jacobi-Matrix

f (x + h) = f(x) + f

0(x)h + o(|h|), |h| → 0 Jacobi-Matrix

f

0= J f = ∂(f

1, . . . , f

n)

∂(x

1, . . . , x

n) = (∂

1f, . . . , ∂

nf ) =

∂

1f

1. . . ∂

nf

1... ...

∂

1f

m. . . ∂

nf

m

Differential

df = ∂f

∂x

1dx

1+ · · · + ∂f

∂x

ndx

nFehlerfortpflanzung bei multivariaten Funktionen absoluter Fehler

∆y = f (x + ∆x) − f (x) ≈ f

x1(x)∆x

1+ · · · + f

xn(x)∆x

nrelativer Fehler

∆y

|y| ≈ c

1∆x

1|x

1| + · · · + c

n∆x

n|x

n| mit den Konditionszahlen

c

i= ∂y

∂x

i|x

i|

|y|

Tangente

Kurve C : t 7→ f(t)

f

0(t

0) 6= 0 ber¨uhrende Gerade

g : f (t

0) + f

0(t

0)(t − t

0), t ∈ R

f

0(t

0) = 0 abrupte ¨ Anderung der Tangentenrichtung m¨oglich

Tangentialebene implizit definierte Fl¨ache

S : f (x

1, . . . , x

n) = c grad f (p) 6= 0 Tangentialebene

E : (grad f(p))

t(x − p) = 0 Tangentialebene f¨ur den Graph einer Funktion x 7→ y = g (x

1, . . . , x

n−1)

E : y − g(q) =

n−1

X

i=1

∂

ig(q) (x

i− q

i)

5.2.2 Ableitungsregeln

Multivariate Kettenregel

h = g ◦ f : x 7→ y = f(x) 7→ z = g (y) Hintereinanderschaltung Multiplikation der Jacobi-Matrizen

h

0(x) = g

0(y)f

0(x), ∂z

i∂x

k= X

j

∂z

i∂y

j∂y

j∂x

kRichtungsableitung

∂

vf (x) = lim

h→0

f(x + hv) − f(x)

h =

d

dt f(x + tv)

t=0

= f

0(x)v bei skalarer Funktion: Anstieg von f in Richtung v, maximal f¨ur v k grad f

Steilster Abstieg

iterative Minimierung multivariater Funktionen x → y : f (y) = min

t≥0

f (x + td), d = − grad f (x) Konvergenz gegen kritische Punkte: grad f(x

∗) = 0

Umkehrfunktion

f : R

n→ R

n, f

0(x

∗) invertierbar = ⇒

f in Umgebung U von x

∗bijektiv, y = f(x) ⇔ x = g(y), und g

0(y) = f

0(x)

−1, x ∈ U

Implizite Funktionen

f : R

n× R

m→ R

n, f(x

∗, y

∗) = 0 mit det f

x(x

∗, y

∗) 6= 0 = ⇒ Gleichungen

f

k(x

1, . . . , x

n, y

1, . . . , y

m) = 0, k = 1, . . . , n, lokal nach x aufl¨osbar: x = ϕ(y), y ≈ y

∗Jacobi-Matrix

ϕ

0= −(f

x)

−1f

y5.2.3 Taylor-Entwicklung

Multivariate Taylor-Approximation

f(x) = X

|α|≤n

1

α! ∂

αf (a)(x − a)

α+ R, |x − a| < r , mit α! = α

1! · · · α

m!

Restglied

R = X

|α|=n+1

1

α! ∂

αf(u)(x − a)

α, u = a + θ(x − a) , f¨ur ein θ ∈ [0, 1]

Hesse-Matrix

quadratische Taylor-Approximation einer skalaren Funktion f f (x

1, . . . , x

n) = f (a) + (grad f (a))

t(x − a) + 1

2 (x − a)

tH f (a)(x − a) + · · · mit

H f (a) =

∂

1∂

1f (a) · · · ∂

1∂

nf(a)

... ...

∂

n∂

1f(a) · · · ∂

n∂

nf (a)

Multivariates Newton-Verfahren nichtlineares Gleichungssystem

f

1(x

∗) = · · · = f

n(x

∗) = 0, x

∗∈ R

niterative Approximation der L¨osung x

∗x

neu= x

alt− ∆x, f

0(x

alt)∆x = f (x

alt) det f

0(x

∗) 6= 0 = ⇒ lokal quadratische Konvergenz

|x

neu− x

∗| ≤ c |x

alt− x

∗|

25.2.4 Extremwerte

Kritischer Punkt

grad f (x

∗) = 0, Typbestimmung mit Eigenwerten λ

kder Hesse-Matrix Hf(x

∗)

• Flachpunkt: λ

k= 0

• elliptischer Punkt: λ

k6= 0, gleiches Vorzeichen

• hyperbolischer Punkt: ∃ λ

kmit verschiedenem Vorzeichen

• parabolischer Punkt: λ

kgleiches Vorzeichen, mindestens ein λ

knull Extrema multivariater Funktionen

innerer Punkt:

x

∗lokales Extremum = ⇒

grad f (x

∗) = 0

Minimum (Maximum), falls Eigenwerte der Hesse-Matrix H positiv (negativ) bei zwei Variablen: det H > 0 und Spur H > 0 (< 0)

Randpunkt:

Richtungsableitung ∂

vf (x

∗) > 0 (< 0) f¨ur jede ins Innere zeigende Richtung v Lagrange-Multiplikatoren

x

∗lokale Extremstelle von f unter den Nebenbedingungen g

k(x) = 0, Rang g

0(x

∗) maximal = ⇒

∃ Lagrange-Multiplikatoren λ

kmit

f

0(x

∗) = λ

tg

0(x

∗) Kuhn-Tucker-Bedingung

x

∗lokales Minimum von f unter den Nebenbedingungen g

i(x) ≥ 0, Gradienten der aktiven Gleichungen linear unabh¨angig = ⇒

∃ Lagrange-Multiplikatoren λ

k≥ 0 mit grad f(x

∗) = X

k

λ

kgrad g

k(x

∗) ∧ X

k

λ

kg

k(x

∗) = 0

(λ

k≤ 0 bei lokalem Maximum)

5.3 Mehrdimensionale Integration

5.3.1 Mehrdimensionale Integrale

Simplex

konvexe H¨ulle von n + 1 affin unabh¨angigen Punkten p

0, . . . , p

nin R

nS = {x = X

k

α

kp

k: X

k

α

k= 1, α

k≥ 0}

Volumen

vol S = 1

n! | det(p

1− p

0, . . . , p

n− p

0)|

Parallelepiped

aufgespannt von linear unabh¨angigen Vektoren a

1, . . . , a

nin R

nP = {x = X

i

α

ia

i: 0 ≤ α

i≤ 1}

Volumen

vol P = | det(a

1, . . . , a

n)|

Integrationsbereich Elementarbereich:

begrenzt durch Graphen stetiger Funktionen nach geeigneter orthogonaler Koordinatentransformation a

1≤ x

1≤ b

1a

2(x

1) ≤ x

2≤ b

2(x

1) ...

a

n(x

1, . . . , x

n−1) ≤ x

n≤ b

n(x

1, . . . , x

n−1) regul¨arer Bereich:

bis auf Randkurven bzw. -fl¨achen disjunkte endliche Vereinigung von Elementarbereichen Mehrdimensionales Integral

Grenzwert von Riemann-Summen ¨uber regul¨arem Bereich Z

V

f dV = lim

|∆|→0

X

i

f (P

i)∆V

i, ∆V

i= vol(V

i), P

i∈ V

i, mit |∆| dem maximalen Durchmesser der V

i(i.a. Simplizes oder Parallelepipede) alternative Schreibweisen: R

V

f(x

1, . . . , x

n) dx

1. . . dx

n, R

V

f Satz von Fubini

Integral ¨uber Elementarbereich V : a

j(x

1, . . . , x

j−1) ≤ x

j≤ b

j(x

1, . . . , x

j−1) Z

V

f dV =

b1

Z

a1

b2(x1)

Z

a2(x1)

· · ·

bn(x1,...,xn−1)

Z

an(x1,...,xn−1)

f (x

1, . . . , x

n) dx

n· · · dx

2dx

1unabh¨angig von der Reihenfolge der Variablen, z.B.

b d d b

5.3.2 Variablentransformation

Transformation mehrdimensionaler Integrale

Z

U

f ◦ g | det g

0| dU = Z

V

f dV, V = g(U ) , f¨ur eine bijektiveTransformation g mit det g

0(x) 6= 0, x ∈ U

Spalten von g

0orthogonal = ⇒

| det g

0| =

n

Y

i=1

∂g

∂x

iy = g(x) = Ax + b (affine Transformation) = ⇒

dy = | det A| dx Volumenelement in Zylinderkoordinaten

x = % cos ϕ, y = % sin ϕ, z = z = ⇒ dx dy dz = %d% dϕ dz Integral ¨uber einen Zylinder Z : 0 ≤ % ≤ %

0, 0 ≤ z ≤ z

0Z

Z

f = Z

z00

Z

2π 0Z

%00

f (%, ϕ, z) % d% dϕ dz

Volumenelement in Kugelkoordinaten

x = r sin ϑ cos ϕ, y = r sin ϑ sin ϕ, z = r cos ϑ = ⇒ dx dy dz = r

2sin ϑ dr dϑ dϕ Integral ¨uber eine Kugel K : 0 ≤ r ≤ R

Z

K

f =

2π

Z

0 π

Z

0 R

Z

0

f (r, ϑ, ϕ) r

2sin ϑ dr dϑ dϕ

5.3.3 Kurven- und Fl¨ achenintegrale

Kurvenintegral

Z

C

f =

b

Z

a

f (p(t))|p

0(t)| dt f¨ur eine regul¨are Parametrisierung t → p(t) ∈ R

n, p

0(t) 6= 0 unabh¨angig von der Parametrisierung

f = 1 L¨ange von C

Eigenschaften des Kurvenintegrals

• linear: Z

C

αf + βg = α Z

C

f + β Z

C

g

• additiv:

Z

C

f dC = Z

C1

f + Z

C2

f , C = C

1∪

·C

2Regul¨ are Parametrisierung eines Fl¨ achenst¨ ucks

R 3

x

1...

x

n−1

7→ s(x) =

y

1...

y

n

mit einer im Inneren von R bijektiven Abbildung s und linear unabh¨angigen Vektoren ∂

1s(x), . . . , ∂

n−1s(x), x ∈

◦

R

Tangentialebene: aufgespannt durch ∂

ks(x) Fl¨achennormale: Einheitsvektor ξ(x) ⊥ ∂

k(x) Fl¨ achenintegral

Z

S

f dS = Z

R

(f ◦ s) | det(∂

1s, . . . , ∂

n−1s, ξ)| dR

mit s : R 3 (x

1, . . . , x

n−1) 7→ (y

1, . . . , y

n) ∈ S einer regul¨aren Parametrisierung und ξ(x) der (normierten) Fl¨achennormale

Skalierungsfaktor der Fl¨achenelemente:

dS = | det(∂

1s, . . . , ∂

n−1s, ξ)| dR f = 1 Fl¨acheninhalt von S

Fl¨ achenelement in Zylinderkoordinaten

Z

f dS =

zmax

Z Z

2πf (%, ϕ, z ) % dϕ dz

Fl¨ achenelement in Kugelkoordinaten

Z

S

f dS =

2π

Z

0 π

Z

0

f (R, ϑ, ϕ) R

2sin ϑ dϑ dϕ

f¨ur eine Sph¨are S : (ϑ, ϕ) 7→ (R sin ϑ cos ϕ, R sin ϑ sin ϕ, R cos ϑ)

5.3.4 Anwendungen

Schwerpunkt

Masse eines K¨orpers K mit Dichte %

m = Z

K

%(x) dK ν-te Koordinate des Massenschwerpunktes

s

ν= m

−1Z

K

x

ν%(x) dK

%(x) = 1 geometrischer Schwerpunkt Tr¨ agheitsmoment

I = Z

K

dist(x, g)

2%(x) dK mit dist der Abstandsfunktion, g der Achse und % der Dichte Volumen eines Rotationsk¨ orpers

V = π

Z

b af (x)

2dx

= πc

2(b − a) + 2π Z

dc

rh(r) dr

a x b

h(r) c = f (a)

d = f (b) r = f(x)

y = f(x)

5.3.5 Integrals¨ atze

Hauptsatz f¨ ur Mehrfachintegrale

Z

V

∂

νf = Z

∂V

f ξ

ν⇔ Z

V

grad f = Z

∂V

f ξ mit ξ der nach außen gerichteten Einheitsnormalen von ∂V

Mypartielle Integration bei Funktionen mehrerer Ver¨ anderlicher

Z

V

f (∂

νg) = Z

∂V

f g ξ

ν− Z

V

(∂

νf ) g mit ξ der nach außen gerichteten Einheitsnormalen von ∂V

Z

Rn

g ∂

αf = (−1)

|α|Z

Rn

f ∂

αg

f¨ur glatte Funktionen, die ausserhalb einer beschr¨ankten Menge verschwinden oder gen¨ugend schnell ab- fallen

Greensche Integralformeln

Z

∂V

f ∂

⊥g = Z

V

(grad f)

tgrad g + f ∆g Z

∂V

f ∂

⊥g − g∂

⊥f = Z

V

f∆g − g∆f

mit ∂

⊥g der Ableitung in Richtung der nach außen zeigenden Einheitsnormalen ξ von ∂V f = 1

Z

∂V

∂

⊥g = Z

V